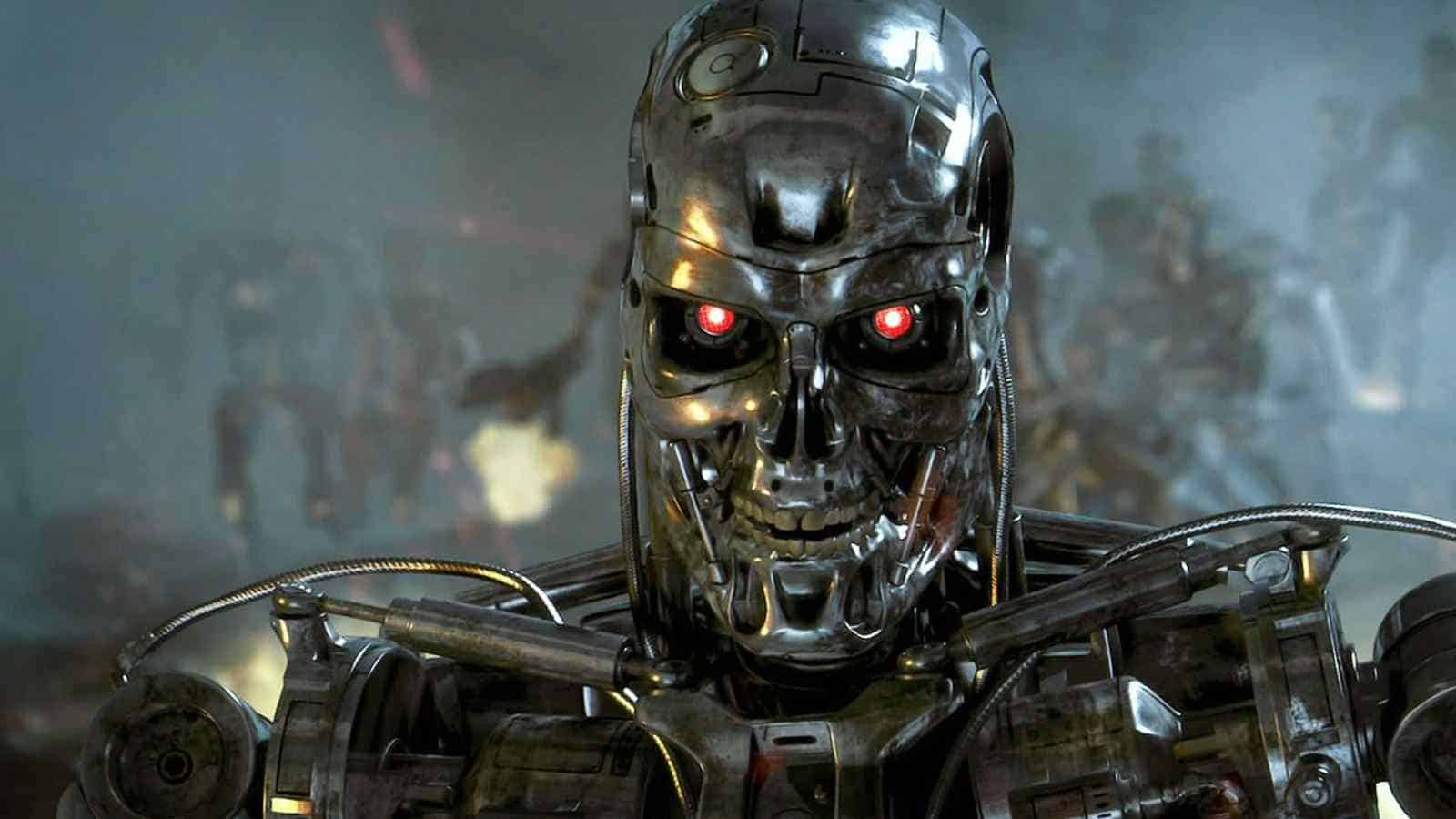

I vecchi film di fantascienza forse dovrebbero darci qualche avvertimento in più sull’IA di quanti non ne cogliamo

L’Intelligenza Artificiale è sempre più mescolata nella nostra vita in molteplici forme e le preoccupazioni riguardanti il suo sviluppo futuro sono al centro dei pensieri di tutti. Dario Amodei, CEO di Anthropic, ha sollevato un vero e proprio allarme durante un’intervista al podcast di Ezra Klein del New York Times, mettendo in luce l’approccio distintivo della sua azienda nello sviluppo dei modelli di IA. Amodei ha avvertito che il passaggio al livello 4, caratterizzato da comportamenti catastrofici e una potenziale autonomia dei modelli, potrebbe verificarsi entro il 2025-2028. Questo solleva serie preoccupazioni circa un possibile sviluppo di un IA “autosufficiente” e “autoreplicante”.

Quando l’IA supera il limite

Le implicazioni di un’IA con queste caratteristiche sollevano grandi preoccupazioni, in particolare riguardo l’uso potenzialmente dannoso che potrebbe essere fatto da parte dei singoli paesi, come Amodei ha tenuto ad evidenziare. Paesi come Corea del Nord, Cina o Russia potrebbero sfruttare l’IA per fini offensivi, con conseguenze geopolitiche di vasta portata in cui tutti potremmo essere potenziali vittime.

Non si tratta, comunque, solo di problematiche legate ad un possibile uso bellico. La possibilità che l’IA raggiunga il livello 4 solleva questioni fondamentali sulla sicurezza e soprattutto sul controllo, perché potrebbe essere in grado di replicarsi e sopravvivere autonomamente. Si, avete capito bene, potrebbe sfuggire al controllo umano. Questo scenario apocalittico richiede un’analisi approfondita dei rischi e una regolamentazione adeguata che ancora non esiste.

Amodei ha enfatizzato l’urgenza di affrontare queste sfide, sottolineando che non si tratta di un problema distante nel tempo ma di una minaccia imminente che richiede azioni concrete. Le sue osservazioni possono sembrare esagerate, magari tratte da qualche film distopico degli anni ‘80/’90, ma in realtà derivano dall’esperienza formata nel campo dell’IA, avendo lavorato al progetto GPT-3 presso OpenAI prima di fondare Anthropic.

Prevenire è meglio che curare

L’appello all’azione di Amodei mette in evidenza la necessità di una risposta responsabile e coordinata a livello mondiale. Sebbene l’IA offra immense potenzialità, come abbiamo avuto modo di vedere in questi primi anni della sua vita, comporta anche rischi significativi. Pertanto il coinvolgimento di governi, istituzioni e organizzazioni internazionali è essenziale per garantire uno sviluppo e un utilizzo sicuro dell’IA per l’intera umanità.