Le GPU NVIDIA Rubin fanno il loro ingresso ufficiale nell’infrastruttura cloud di Google, con una collaborazione che punta a mettere a disposizione degli utenti fino a quasi un milione di GPU per alimentare le nuove istanze A5X. Non si tratta di un semplice aggiornamento hardware. Quanto di un cambio di scala piuttosto significativo nel modo in cui vengono gestiti i carichi di lavoro legati all’AI

La partnership tra le due aziende ruota attorno a un obiettivo preciso, ossia ridurre i costi di inferenza e aumentare il throughput per token. E il veicolo principale di questa strategia sono proprio le istanze A5X, progettate per sfruttare gli acceleratori di rete di NVIDIA e costruire infrastrutture di calcolo a cluster singolo o multi cluster pensate specificamente per i workload AI.

GPU NVIDIA Rubin, cosa sono le istanze A5X e perché contano

Le istanze A5X rappresentano l’ultimo tassello del portafoglio AI Hypercomputer di Google. Lo stesso ecosistema che alimenta la piattaforma Gemini e le varie offerte AI dell’azienda, sia per il mercato consumer che per quello enterprise. Google ha annunciato una serie di aggiornamenti ad Hypercomputer. Tra cui: nuove macchine virtuali basate su CPU Arm personalizzate, processori tensoriali di ottava generazione, supporto nativo a PyTorch per le TPU e, appunto, le istanze A5X.

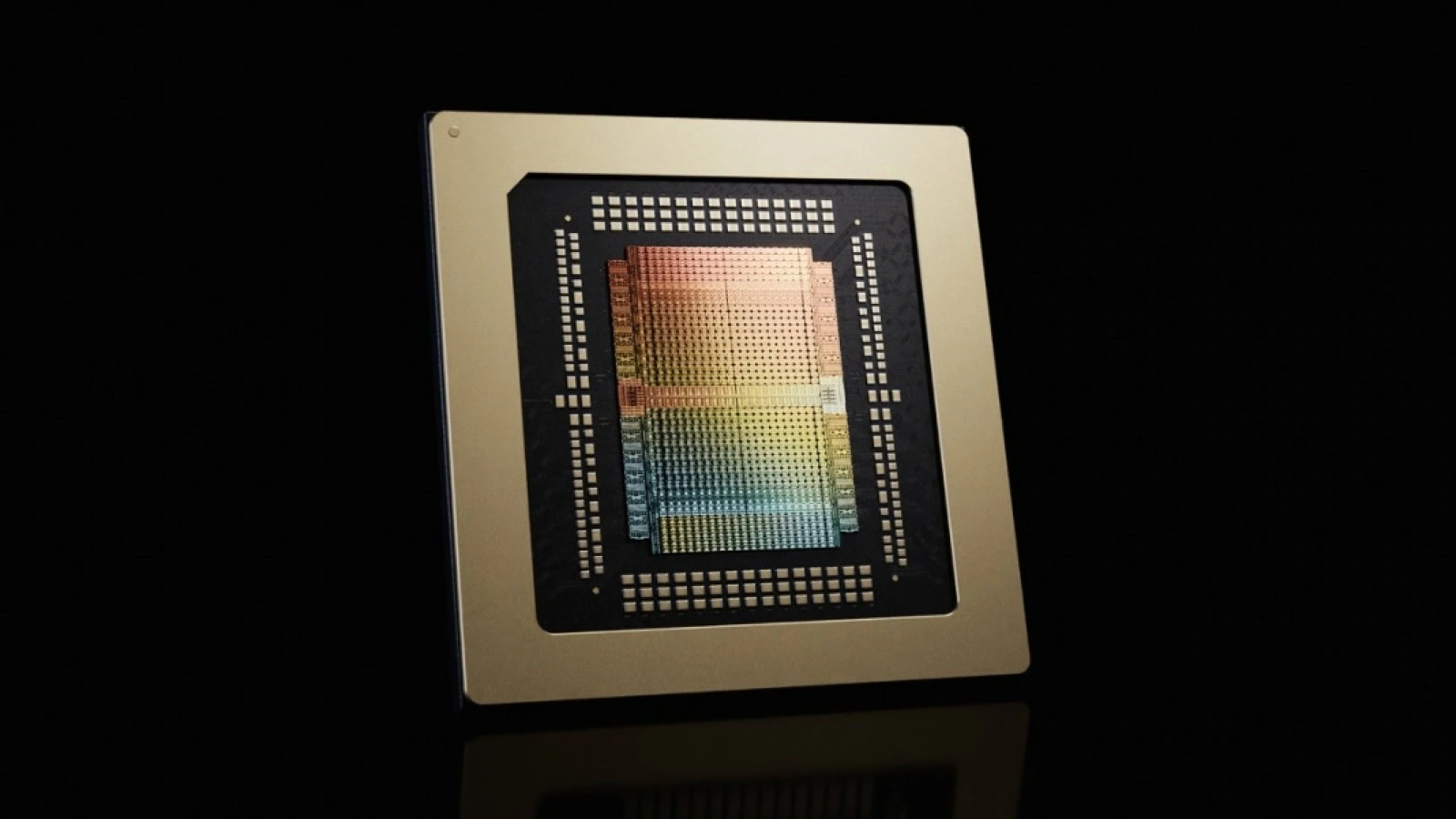

Il punto chiave è che tutto questo è orientato verso i carichi di lavoro di tipo agentic AI. Cioè quelli che si basano su gruppi di agenti AI capaci di affrontare un problema suddividendolo in sotto attività. Le istanze A5X sono le prime di Google progettate per funzionare con le GPU NVIDIA Rubin di ultima generazione. Ciò le rende particolarmente interessanti per chi opera in ambiti dove la potenza di calcolo distribuita è fondamentale.

Quasi un milione di GPU in un cluster multi sito

Scendendo nei dettagli tecnici, le istanze A5X utilizzano le schede di rete ConnectX-9 di NVIDIA, pensate per accelerare i carichi AI su infrastrutture cloud basate su ethernet. Queste NIC, combinate con la piattaforma Virgo di Google, permettono di accedere fino a 80.000 GPU Rubin in un singolo cluster e fino a 960.000GPU in un cluster distribuito su più siti. Numeri che fanno una certa impressione.

La piattaforma Virgo, va detto, non lavora solo con le GPU NVIDIA Rubin. Supporta anche le unità di elaborazione tensoriale (TPU) di Google, riuscendo a collegare fino a 134.000 TPU in un singolo data center e oltre un milione di chip su più sedi. Secondo quanto dichiarato da NVIDIA, le istanze A5X sono in grado di offrire costi di inferenza per token 10 volte inferiori e un throughput per megawatt 10 volte superiore rispetto alla generazione precedente. In pratica, si fa molto di più spendendo molto meno in termini energetici ed economici.

NVIDIA ha anche fatto un cenno al tema dell’AI applicata al mondo fisico e industriale. Prodotti di aziende come Cadence e Siemens vengono alimentati dalla sua infrastruttura e sono disponibili su Google Cloud. La piattaforma Gemini di Google, inoltre, può distribuire modelli e flussi di lavoro agentici in settori come la cybersecurity.