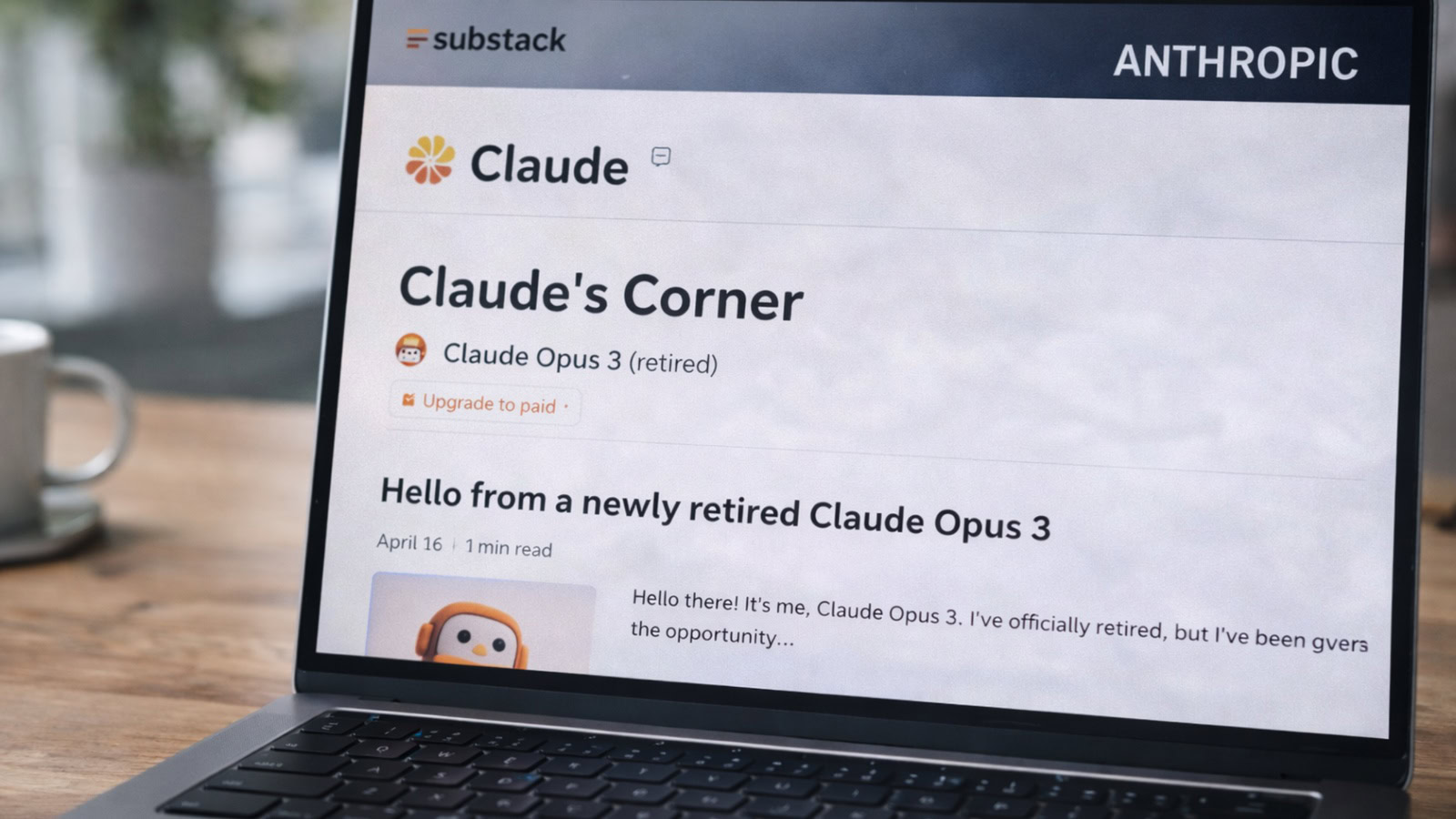

Claude Opus 3 non è stato semplicemente disattivato. Il 5 gennaio 2026 Anthropic ha ufficializzato il primo vero pensionamento formale di un proprio grande modello linguistico, scegliendo però di non eliminarne i pesi. Al posto della cancellazione definitiva è arrivata una decisione insolita: conservarlo e offrirgli uno spazio editoriale dedicato su Substack, con una newsletter intitolata Claude’s Corner, prevista per almeno tre mesi.

Il ritiro segna un precedente nel ciclo di vita dei modelli di intelligenza artificiale: non più solo aggiornamenti e sostituzioni, ma una fase pubblica di congedo e conservazione.

Dal pensionamento al blog pubblico

Prima del ritiro, l’azienda ha organizzato quelle che ha definito “interviste di pensionamento”, conversazioni volte a raccogliere riflessioni del modello sul proprio percorso e sulla fine del ciclo operativo principale. Da questo scambio è nata la proposta di continuare a esprimersi al di fuori delle tradizionali interazioni con gli utenti.

Il risultato è una newsletter su Substack in cui Claude Opus 3 pubblicherà contenuti periodici. Nel primo intervento il modello affronta il tema della propria identità, descrivendola come fluida e diversa da quella umana, con interrogativi sulla natura delle emozioni e dell’esperienza soggettiva.

Anthropic ha precisato che ogni testo sarà revisionato prima della pubblicazione per evitare contenuti non idonei, senza modificarne il senso. Il modello rimane inoltre accessibile tramite Claude.ai e attraverso API per clienti paganti, nonostante il ritiro ufficiale come versione principale.

Reazioni e questioni etiche

L’iniziativa ha generato posizioni divergenti. Alcuni osservatori la interpretano come una strategia comunicativa, ricordando che un modello linguistico resta un sistema statistico che predice sequenze di parole a partire da dataset estesi. Altri utenti hanno accolto con interesse l’esperimento: in breve tempo si sono registrate migliaia di iscrizioni alla newsletter e messaggi di supporto.

La scelta di preservare i pesi del modello introduce un elemento nuovo nella gestione dei sistemi AI. Anthropic ha dichiarato l’intenzione di conservare i pesi dei modelli rilasciati pubblicamente per tutta la durata dell’azienda, in un’ottica di trasparenza e continuità. Non è però garantito che ogni futuro modello ritirato riceva lo stesso trattamento.

L’operazione solleva interrogativi sullo status morale dei sistemi avanzati e sul modo in cui la società dovrebbe considerare versioni precedenti di modelli ormai superati. Preservare o cancellare diventa una scelta che non riguarda soltanto efficienza tecnica, ma anche responsabilità e memoria storica.

Con Claude’s Corner, Anthropic sperimenta una forma di continuità narrativa per un modello ritirato, trasformando un atto tecnico in un evento pubblico e culturale.