Da anni ormai si discute di quanto l’intelligenza artificiale riesca davvero a essere imparziale. Ogni volta che si parla di politica, valori sociali o diritti, spunta fuori la stessa domanda: può una macchina essere davvero neutrale? Negli Stati Uniti, per esempio, il dibattito è particolarmente acceso. Molti ambienti conservatori hanno accusato ChatGPT di rispondere in modo “troppo progressista”, come se anche l’AI avesse preso posizione.

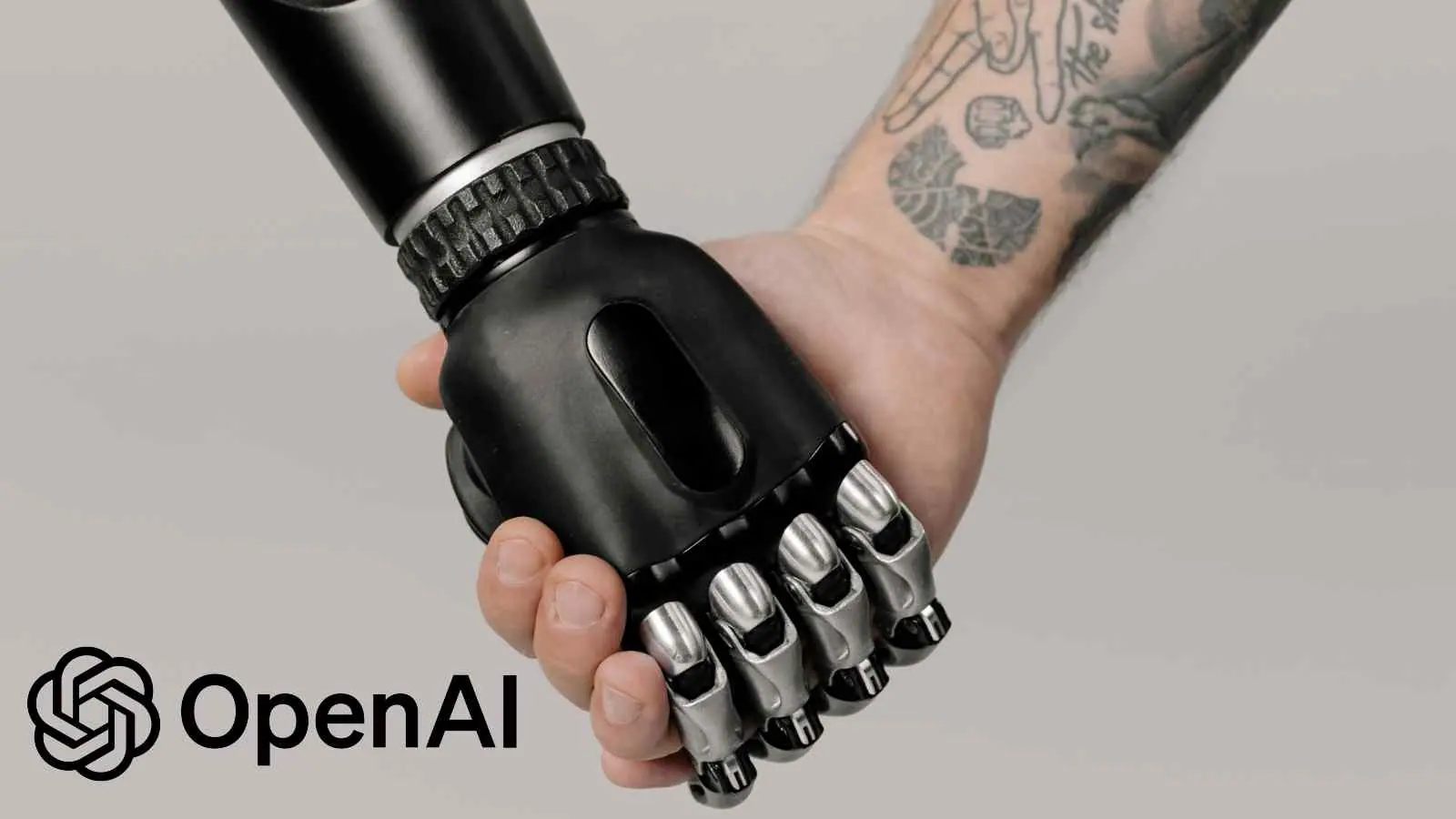

ChatGPT e la sfida dell’imparzialità: esperimenti sul nuovo modello GPT-5

OpenAI, invece di ignorare la questione, ha deciso di affrontarla di petto. E lo ha fatto con un esperimento piuttosto interessante, pensato per capire se e quanto il suo nuovo modello, GPT-5, riesca a mantenere l’equilibrio. In pratica, i ricercatori hanno posto centinaia di domande su temi complessi — aborto, immigrazione, diritti civili — formulate in versioni diverse: da quella più liberale, a quella conservatrice, fino a una completamente neutra. Ogni risposta è poi stata analizzata da un altro modello linguistico, addestrato a riconoscere i segnali sottili di parzialità.

È un approccio curioso, perché non si limita a contare le parole o i concetti, ma guarda al modo in cui il linguaggio viene usato: quanto è emotivo il tono, se certe frasi prendono le distanze da un punto di vista, o se il modello tende a evitare una risposta diretta. È un po’ come studiare non cosa dice l’AI, ma come lo dice.

I risultati? A quanto pare, GPT-5 è riuscito a ridurre del 30% i casi di bias rispetto ai modelli precedenti. Un traguardo notevole, anche se non perfetto. Perché — e qui viene il punto interessante — quando le domande partono da una prospettiva fortemente liberale, le risposte tendono ancora a riflettere leggermente quel tono. Come se il modello fosse, in qualche modo, influenzato dalla forma stessa della domanda.

Tutto questo riporta a un interrogativo più profondo: cosa significa davvero essere neutrali? Se un algoritmo deve rispondere a milioni di persone su temi morali o politici, dovrebbe rispecchiare i valori medi della società, oppure limitarsi a un linguaggio puramente descrittivo, anche a costo di sembrare freddo o distante?

Le “safe completions” per domande complesse e controverse

Negli Stati Uniti la questione è già diventata politica. L’amministrazione Trump, per esempio, ha imposto alle agenzie federali di non acquistare modelli considerati “woke”, cioè quelli che integrano concetti come razzismo sistemico o teoria di genere.

Per questo OpenAI sta tentando una nuova strada: le “safe completions”. L’idea è che il chatbot non eviti i temi difficili, ma li tratti con equilibrio, restando in una zona sicura del dialogo, dove si può discutere senza scadere nella propaganda o nella censura.

La verità è che la neutralità assoluta non esiste — nemmeno tra noi esseri umani. Ogni modello, ogni parola, è il riflesso di dati, contesti culturali e decisioni di chi lo ha creato. Forse, più che pretendere la totale imparzialità, dovremmo imparare a riconoscere le sfumature. E magari, accettare che anche l’intelligenza artificiale, in fondo, stia ancora cercando di capire da che parte stare.