Durante il keynote di apertura del Google I/O 2025, l’azienda ha presentato una serie di aggiornamenti per la famiglia Gemini 2.5, puntando a realizzare un assistente AI capace di pianificare, ragionare e agire in modo proattivo. A dichiararlo è stato Demis Hassabis, CEO di Google DeepMind: “L’obiettivo finale per l’app Gemini è renderla personale, potente e autonoma”.

I miglioramenti coinvolgono sia Gemini 2.5 Pro, il modello più avanzato, sia 2.5 Flash, pensato per efficienza e velocità. Entrambi sono stati ottimizzati per prestazioni superiori, maggiore usabilità e interazione multimodale, senza trascurare sicurezza e strumenti per sviluppatori.

Gemini 2.5 Pro: contesto esteso e Deep Think

Gemini 2.5 Pro dispone ora di una finestra contestuale da un milione di token, utile per gestire documenti lunghi e contenuti video. È il primo in classifica su WebDev Arena e domina tutte le categorie su LMArena, benchmark che valuta le preferenze umane. Il modello eccelle anche nel settore educativo grazie all’integrazione con la serie LearnLM, ottenendo riconoscimenti da esperti e docenti.

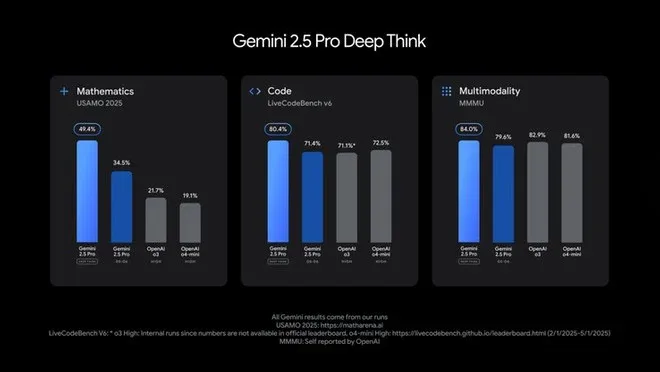

Una delle novità più importanti è Deep Think, modalità sperimentale che permette di valutare ipotesi multiple prima di rispondere. I primi risultati sono promettenti: punteggi elevati nei test USAMO 2025, LiveCodeBench per la programmazione e MMMU per il ragionamento multimodale. Il modello ha inoltre superato positivamente Humanity’s Last Exam, test di conoscenza e inferenza generale.

Per ora, Deep Think è disponibile solo tramite API Gemini a un gruppo ristretto di tester, mentre Google continua a valutarne l’impatto in termini di sicurezza.

Gemini 2.5 Flash: meno token, più efficienza

Gemini 2.5 Flash è stato aggiornato per essere più leggero: utilizza il 20–30% di token in meno e ha migliorato le performance su benchmark legati a multimodalità, ragionamento, codice e contesti estesi. È disponibile in anteprima tramite Google AI Studio, Vertex AI e l’app Gemini, con rilascio generale previsto per l’inizio di giugno.

Voce naturale e dialogo empatico

Tra le novità più tangibili, Google ha introdotto output audio nativo tramite API Live, con supporto a tono, accento e stile narrativo personalizzabili. È già possibile, ad esempio, richiedere una voce “melodrammatica” per raccontare una storia. I modelli sono in grado di cambiare lingua in tempo reale, utilizzare sussurri e distinguere sfumature emotive nel parlato.

Sono in fase di test funzionalità vocali avanzate:

Rilevamento dell’emozione nella voce dell’utente;

Interazione proattiva, con risposta al momento opportuno;

Ragionamento audio in tempo reale per compiti vocali complessi.

Project Mariner, sicurezza e nuovi strumenti

Google ha esteso Project Mariner all’API Gemini e a Vertex AI: gli agenti AI possono ora navigare autonomamente le pagine web ed eseguire azioni online, una funzione già adottata da diversi partner aziendali. In arrivo anche nuove protezioni contro le prompt injection indirette, che migliorano la resilienza del modello contro attacchi nascosti nei dati.

Sul fronte sviluppatori, Gemini 2.5 integra ora riassunti del ragionamento e “budget cognitivi” regolabili per bilanciare accuratezza, latenza e costi. A questi si aggiungono nuovi SDK per Model Context Protocol, per facilitare l’integrazione con strumenti open source.

Ricerca, ascolto e innovazione costante

“Stiamo entrando in una nuova fase per l’intelligenza artificiale”, ha affermato Hassabis. Google punta a consolidare Gemini come infrastruttura AI di riferimento, combinando potenza computazionale, sicurezza avanzata e esperienza utente fluida. Altri aggiornamenti sono previsti nei prossimi mesi, segno di una roadmap ambiziosa e in costante evoluzione.