La partnership tra Meta e Amazon Web Services si rafforza con un accordo che punta dritto al cuore dell’intelligenza artificiale. L’azienda di Mark Zuckerberg ha deciso di adottare su larga scala i processori Graviton sviluppati da Amazon, con un dispiegamento iniziale che coinvolge decine di milioni di core e la possibilità concreta di espansione progressiva nel tempo. Una mossa che racconta molto di come stia cambiando il modo in cui le grandi piattaforme tecnologiche costruiscono le proprie infrastrutture.

Il punto è questo: le GPU continuano a essere fondamentali per l’addestramento dei modelli di intelligenza artificiale, nessuno lo mette in discussione. Però il panorama sta evolvendo rapidamente. I cosiddetti sistemi agentici, quelli capaci di ragionare, pianificare ed eseguire attività complesse in autonomia, stanno facendo crescere in modo significativo la domanda di carichi di lavoro che dipendono dalla CPU più che dalla GPU. Ragionamento in tempo reale, generazione di codice, ricerca avanzata, orchestrazione di processi articolati su più passaggi: tutte operazioni che richiedono capacità di calcolo distribuite e molto efficienti. Ed è proprio qui che entrano in gioco i chip Graviton.

Cosa offre Graviton5 e perché Meta lo ha scelto

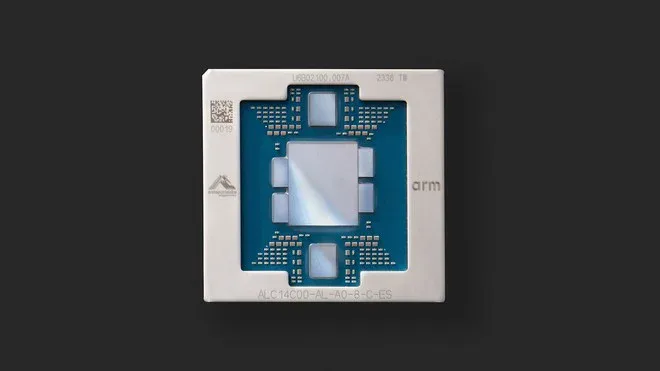

Il protagonista tecnico di questo accordo è Graviton5, progettato specificamente per affrontare questo tipo di utilizzi. Il chip mette in campo 192 core e una cache ampliata fino a cinque volte rispetto alla generazione precedente. Le latenze interne si riducono fino al 33%, il che si traduce in una maggiore velocità nel trattamento dei dati e in una banda complessivamente più elevata. Per sistemi di intelligenza artificiale che operano in modo continuo su flussi complessi, questi numeri fanno la differenza.

Le nuove istanze basate su Graviton5 sfruttano anche il Nitro System di AWS, una combinazione di componenti hardware e software dedicati che garantisce prestazioni elevate, sicurezza e isolamento tra i diversi carichi di lavoro. C’è poi il supporto all’Elastic Fabric Adapter, pensato per migliorare la comunicazione tra più istanze con bassa latenza e banda elevata. Un aspetto tutt’altro che secondario quando i carichi AI vengono distribuiti su larga scala, come nel caso di Meta.

Una strategia di diversificazione per le risorse di calcolo

Guardando la questione da un punto di vista più ampio, la scelta di Meta riflette anche una precisa strategia di diversificazione delle risorse di calcolo. Non si tratta solo di trovare hardware più potente, ma di costruire un ecosistema flessibile in cui diversi tipi di processori vengano impiegati per i compiti a cui sono più adatti. Le GPU restano il pilastro per l’addestramento, mentre i chip Graviton di AWS si occupano di quei carichi inferenziali e operativi dove la CPU fa davvero la differenza.