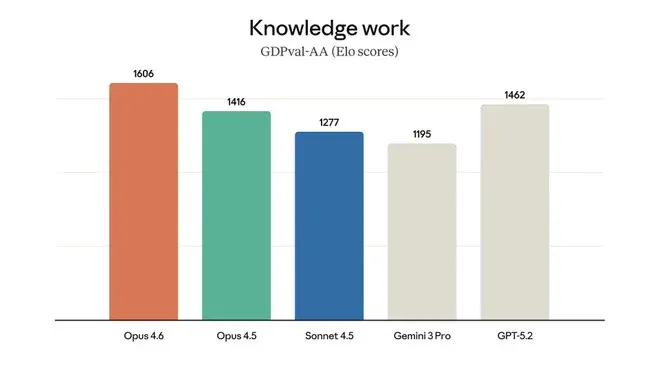

Il confronto tra Anthropic e OpenAI entra in una nuova fase. A pochi minuti di distanza, le due aziende hanno annunciato aggiornamenti importanti ai rispettivi strumenti di coding agentico: prima Opus 4.6, poi GPT-5.3 Codex. Una sequenza così ravvicinata da sembrare una risposta diretta, che conferma quanto la competizione si stia spostando dal semplice supporto al codice verso agenti capaci di operare su flussi di lavoro complessi.

L’obiettivo condiviso è superare il ruolo di assistente e trasformare l’AI in un vero esecutore. Non più solo suggerimenti o patch isolate, ma pianificazione, uso coordinato di strumenti e gestione di attività prolungate. Un cambio di prospettiva che coinvolge lo sviluppo software e, sempre di più, il lavoro tecnico quotidiano nel suo insieme.

Opus 4.6 rafforza la solidità operativa

Con Opus 4.6, Anthropic sceglie un approccio pragmatico. L’aggiornamento migliora la continuità nelle attività agentiche di lunga durata e l’affidabilità su codebase estese, dove file e dipendenze diventano difficili da gestire. Anche code review e debugging risultano più accurati, grazie a una maggiore capacità di rilettura e autocorrezione.

La novità tecnica più rilevante è l’introduzione, in beta, di una finestra di contesto da 1 milione di token. Questo consente di lavorare su repository completi o grandi volumi di documentazione senza frammentare il lavoro. In Claude Code debutta inoltre il concetto di agent teams, con più agenti che operano in parallelo su analisi, modifiche e test. L’ambito si estende anche oltre il codice, con potenziamenti in Microsoft Excel e integrazione diretta in Microsoft PowerPoint per attività multi-step.

GPT-5.3 Codex amplia il perimetro

La risposta di OpenAI arriva con GPT-5.3 Codex, presentato come il modello Codex più completo finora. L’aggiornamento combina le capacità di coding della versione precedente con un ragionamento più ampio e un aumento di velocità dichiarato del 25%, pensato per sessioni lunghe e meno frammentate.

Codex viene posizionato come agente capace di gestire non solo sviluppo, test e debugging, ma anche deployment, analisi dei dati e produzione di documenti. Nei benchmark come Terminal-Bench 2.0 e SWE-Bench Pro, il modello mostra progressi in scenari realistici di ingegneria del software. Secondo OpenAI, le versioni preliminari sono già state utilizzate internamente per analizzare log e supportare la messa in produzione, segno di un utilizzo sempre più operativo.