A bordo dei nuovi Google Pixel 10, il colosso americano ha introdotto un sistema di tracciamento delle immagini molto particolare. Questo si basa sul protocollo C2PA, il quale è in grado di aggiungere metadati crittografati utili a distinguere gli scatti reali da quelli modificati. Più precisamente il tutto avviene mediante l’uso di strumenti di intelligenza artificiale. La volontà principale è quella di garantire più trasparenza e aiutare a capire se una foto è “genuina” o se è stata alterata. Ma i primi test dimostrano che il sistema non è infallibile.

Come funziona il C2PA sui Pixel 10

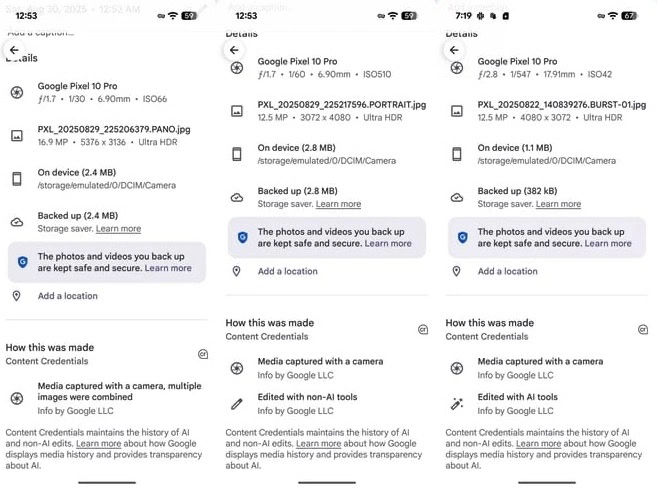

Screenshot

Le foto vengono classificate in tre modi:

“Media captured with a camera”, per gli scatti originali senza interventi o con piccole regolazioni di base;

“Edited with non-AI tools”, per le modifiche tradizionali come filtri, rotazioni o regolazioni della luminosità;

“Edited with AI tools”, quando l’immagine viene alterata in maniera sostanziale tramite intelligenza artificiale.

Questa etichetta è resa possibile dai metadati C2PA, che non solo segnalano la natura della modifica ma sono anche protetti da crittografia, così da non poter essere alterati.

Il problema: la rimozione dei metadati

Come spiegato da alcuni test riportati in rete, pur non essendo possibile falsificare i metadati (non si può trasformare un’immagine marcata come modificata con AI in una senza), è invece relativamente semplice rimuoverli del tutto. Strumenti comuni come exiftool permettono, con un solo comando, di eliminare le informazioni C2PA senza toccare gli altri dati Exif. In questo modo, una foto pesantemente modificata dall’AI può apparire “pulita”, priva di segni evidenti di manipolazione.

Un indizio per gli osservatori attenti

Se da un lato questo limita l’efficacia del sistema, dall’altro la totale assenza di metadati C2PA in una foto proveniente da un Pixel 10 può rappresentare un campanello d’allarme. Un osservatore esperto potrebbe infatti interpretare la mancanza come un segnale di manomissione.

La vicenda evidenzia come la lotta alla disinformazione visiva e ai contenuti sintetici generati dall’AI sia complessa: ogni soluzione tecnica rischia di scontrarsi con strumenti di rimozione o bypass, mantenendo alta l’attenzione su un tema cruciale per la fiducia digitale.