Il riconoscimento dei gesti della mano attraverso segnali elettrici muscolari è al centro di una nuova ricerca firmata Apple. I ricercatori di Cupertino hanno pubblicato sul blog Machine Learning Research uno studio che descrive un sistema di intelligenza artificiale capace di interpretare i movimenti delle dita e della mano analizzando l’attività elettrica prodotta dai muscoli. E la cosa davvero interessante è che questo modello riesce a riconoscere anche gesti che non erano presenti nei dati usati durante la fase di addestramento. Cosa che, per chi mastica un po’ di machine learning, è tutt’altro che banale.

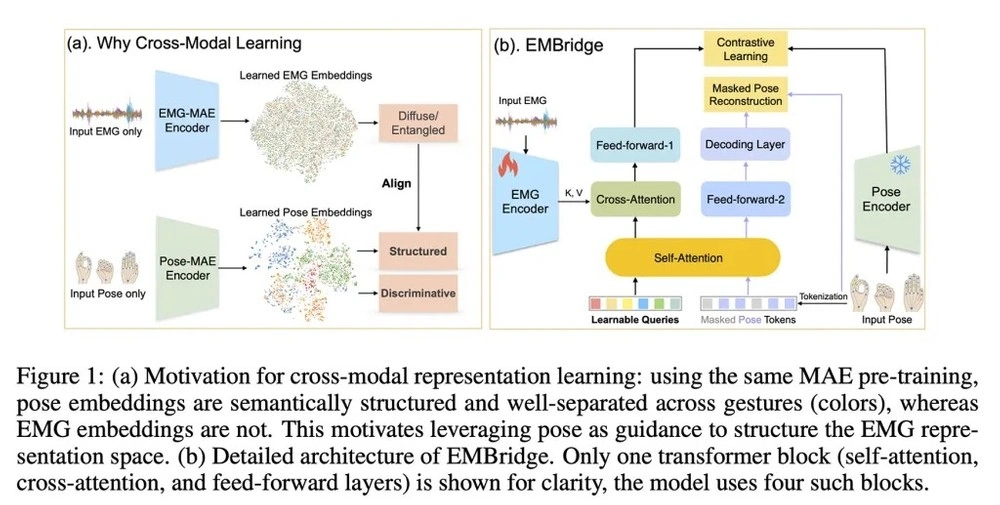

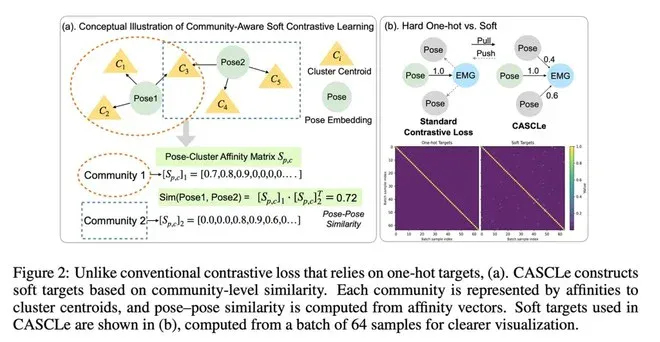

Lo studio si intitola “EMBridge: Enhancing Gesture Generalization from EMG Signals through Cross-Modal Representation Learning” e verrà presentato a ICLR 2026, la conferenza scientifica prevista per aprile. La tecnologia su cui si basa tutto il lavoro è l’elettromiografia, conosciuta anche con la sigla EMG: una tecnica che misura i segnali elettrici generati dai muscoli nel momento in cui si contraggono. Non è una novità in campo medico, dove viene usata da anni per diagnosticare disturbi neuromuscolari o per controllare protesi. Quello che cambia, però, è il contesto applicativo. Perché Apple sta guardando ben oltre la medicina.

Come funziona il sistema di Apple

Il concetto alla base è piuttosto intuitivo: ogni volta che una persona muove la mano o le dita, i muscoli dell’avambraccio producono piccoli segnali elettrici. Se questi vengono captati da sensori e letti da un algoritmo sufficientemente sofisticato, diventa possibile capire quale gesto sta compiendo quella persona senza nemmeno guardarla. Questo apre scenari enormi nel campo dei dispositivi indossabili e delle interfacce digitali, dove la possibilità di interagire senza toccare nulla rappresenta un salto qualitativo notevole.

Negli ultimi anni l’interesse per l’elettromiografia applicata alla tecnologia consumer è cresciuto parecchio, e Apple sembra voler giocare un ruolo di primo piano. Il fatto che il modello riesca a generalizzare, cioè a interpretare correttamente gesti mai visti prima durante il training, lo rende particolarmente promettente per un utilizzo nel mondo reale, dove le persone non compiono mai movimenti identici.

I dati dietro l’addestramento del modello di Apple

Per costruire questo sistema, i ricercatori di Apple hanno fatto leva su dataset molto ampi che combinano segnali EMG con i movimenti reali della mano registrati con estrema precisione. Il dataset principale si chiama emg2pose ed è una raccolta open source che contiene circa 370 ore di registrazioni effettuate su 193 partecipanti. Al suo interno ci sono 29 categorie di movimenti, che spaziano dai gesti discreti ai movimenti continui della mano. Le posizioni sono state tracciate con sistemi di motion capture ad alta risoluzione, generando oltre 80 milioni di etichette di movimento. Una mole di dati impressionante, necessaria per insegnare al modello a distinguere con affidabilità tra gesti anche molto simili tra loro.