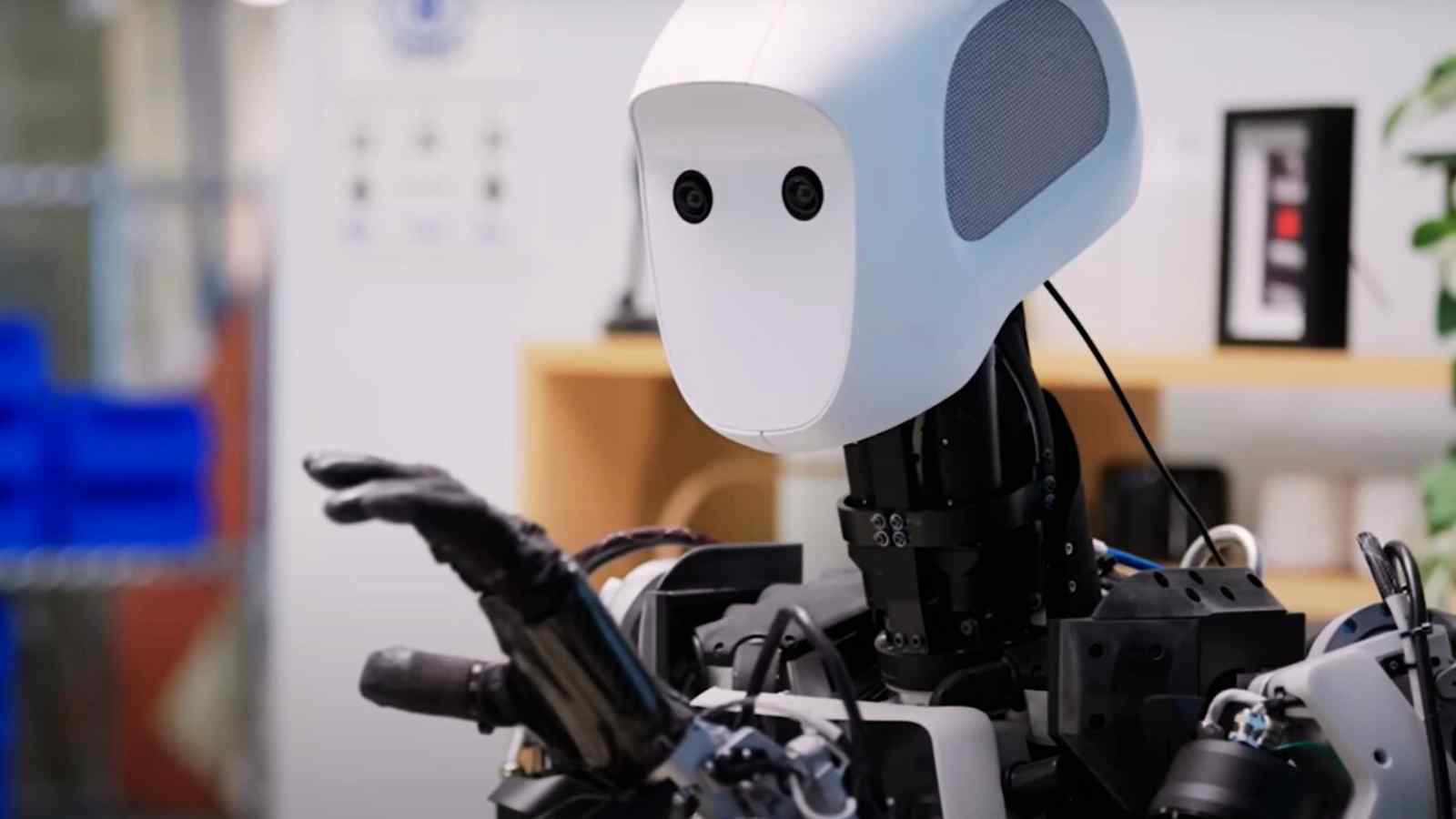

Quando si parla di robot umanoidi, il rischio è sempre lo stesso: video spettacolari, movimenti impressionanti e poi, nella vita reale, macchine che funzionano solo in ambienti iper-controllati. Google DeepMind sembra però voler spostare il discorso su un piano diverso, più concreto e forse anche più interessante. Con le ultime dimostrazioni dedicate ad Apollo, il robot sviluppato da Apptronik e potenziato dai modelli Gemini, l’idea non è stupire con la forza o la velocità, ma mostrare qualcosa di molto più sottile: la capacità di cavarsela quando le cose non vanno come previsto.

Nel video diffuso online, Apollo si trova davanti a oggetti che non ha mai visto prima. Non sono forme perfette, non sono sempre rigide, non sono posizionate con precisione millimetrica. Eppure il robot riesce ad afferrarli, spostarli, riconoscerli e reagire a semplici comandi vocali. “Prendi il blocco verde”, detto così, senza istruzioni dettagliate, senza coordinate. Apollo ascolta, osserva l’ambiente e agisce. Se qualcosa cambia, come la posizione di un contenitore o di un utensile, il comportamento si adatta di conseguenza. È una scena che assomiglia più a un laboratorio condiviso o a una casa reale che a una linea di produzione.

Il punto chiave sta tutto nell’AI che guida questi movimenti. DeepMind parla di Gemini Robotics e di controllo “multi-embodiment”, un concetto che, tradotto in modo semplice, significa usare la stessa intelligenza artificiale su corpi diversi. Non importa se si tratta di un braccio robotico o di un umanoide completo: il modello impara osservando dimostrazioni, capisce istruzioni in linguaggio naturale e pianifica azioni senza dover essere riaddestrato da zero ogni volta. È un cambio di mentalità netto rispetto alla robotica tradizionale, dove ogni nuovo compito richiede settimane di programmazione e test.

Accanto ad Apollo, DeepMind ha mostrato anche i robot Aloha impegnati in attività che, a prima vista, sembrano banali: preparare un pranzo, riordinare oggetti, rispondere a richieste vocali. In realtà, sono proprio questi compiti a essere difficili, perché il mondo reale è pieno di piccole variazioni imprevedibili. Una tazza non è mai nello stesso punto, un oggetto può scivolare, una presa può fallire. Gestire tutto questo richiede non solo precisione, ma una forma di comprensione del contesto.

Nei giorni precedenti, DeepMind aveva anche accennato a un’idea curiosa: quella di dare ai robot una sorta di “monologo interno”. In pratica, la macchina osserva un’azione, la descrive mentalmente in linguaggio naturale e usa questa descrizione per imparare. È un meccanismo che rende possibile apprendere anche senza esempi diretti, un aspetto fondamentale quando ci si trova davanti a situazioni nuove.

Certo, i limiti restano. Apollo non è ancora delicato come una mano umana e alcuni gesti semplici per noi restano complicati per una macchina. Ma quello che emerge da queste dimostrazioni è una sensazione chiara: il confine tra robot super specializzati e assistenti più generici si sta facendo sempre più sottile. E forse, per la prima volta, non sembra più solo una promessa lontana.