Cerchia e cerca

Google spinge ancora più in là l’integrazione dell’intelligenza artificiale nel cuore del suo ecosistema Android. Questa volta tocca a Cerchia e Cerca, la funzione che consente di avviare ricerche contestuali direttamente da ciò che appare sullo schermo. Con il nuovo aggiornamento della Google App (versione 16.47.49 beta), la classica ricerca visiva lascia spazio alla AI Mode, che diventa l’opzione predefinita, trasformando radicalmente il modo in cui gli utenti interagiscono con le informazioni.

Un’esperienza di ricerca più interattiva e conversazionale

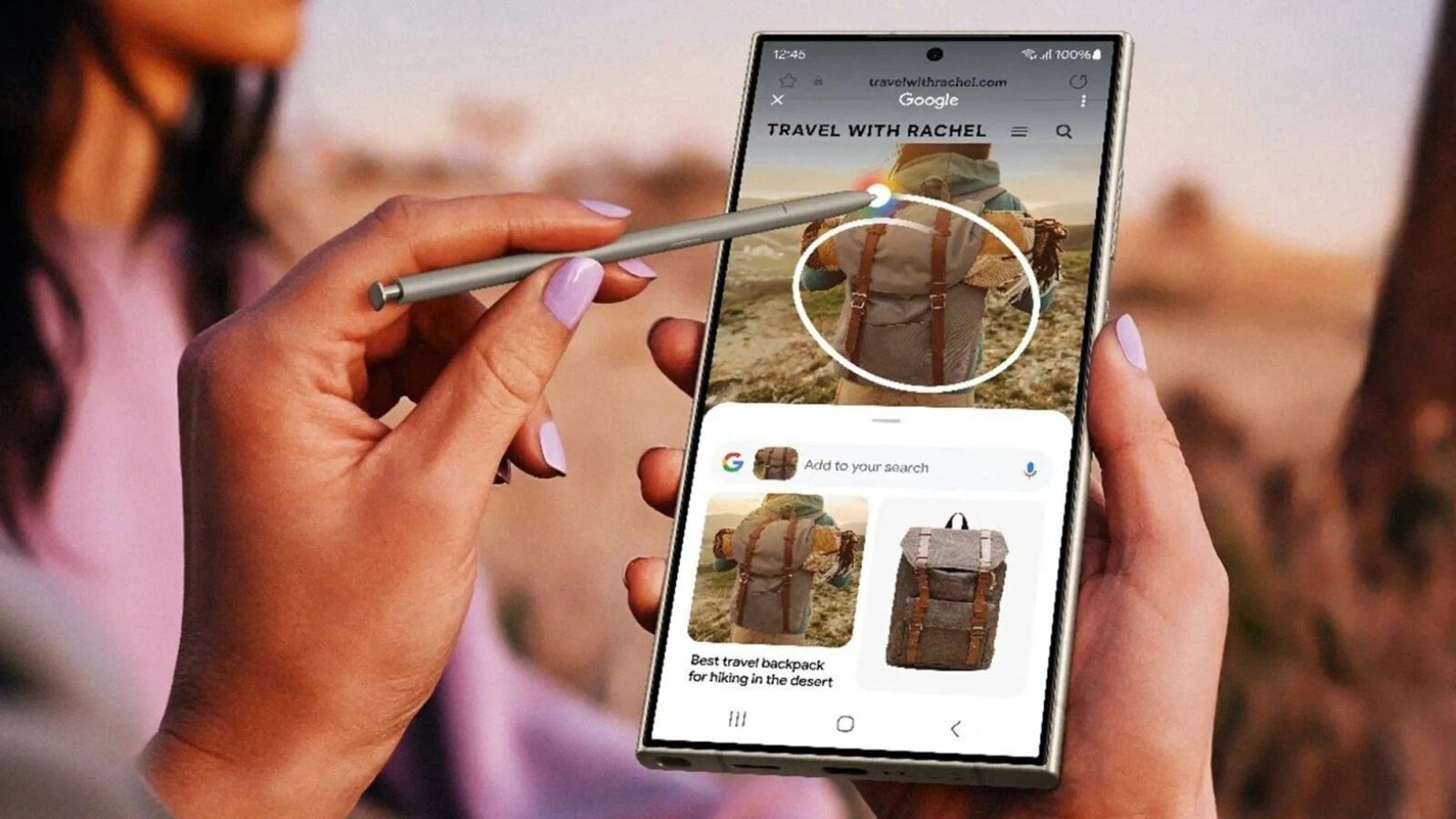

Fino a oggi, Cerchia e Cerca (Circle to Search) permetteva di identificare oggetti, testi o elementi visivi sullo schermo con un semplice gesto, restituendo risultati statici basati su Google Lens. Con la nuova modalità, entra in scena l’intelligenza artificiale generativa: i risultati vengono ora elaborati e spiegati in linguaggio naturale, con la possibilità di continuare la conversazione direttamente dalla schermata dei risultati.

In pratica, cerchiando un elemento, l’utente non riceverà più una serie di link o immagini correlate, ma un riassunto dinamico generato dall’AI, a cui potrà aggiungere prompt o domande di approfondimento. Il tutto senza cambiare app o contesto, con la barra di ricerca ora posizionata in basso, più accessibile e pronta per l’interazione testuale o vocale.

Da ricerca visiva a ricerca intelligente

Questa nuova iterazione di Cerchia e Cerca non è solo un aggiornamento estetico: rappresenta una ridefinizione dell’esperienza di ricerca su Android. La AI Mode diventa, di fatto, il punto d’accesso principale per ogni tipo di informazione, sostituendo la tradizionale ricerca per immagini o parole chiave con un flusso di dialogo guidato.

Un esempio pratico: cerchiando un paio di scarpe in un video, l’AI non solo mostrerà modelli simili, ma potrà suggerire dove acquistarli, spiegare le differenze tra materiali o persino proporre outfit compatibili, tutto nel corso della stessa conversazione. È un approccio che rispecchia perfettamente la visione di Google Search come assistente cognitivo, piuttosto che come semplice motore di ricerca.

Un tassello della strategia AI-first di Google

Questa integrazione segue una linea ormai chiara: la AI Mode è il centro della nuova generazione di servizi Google. Dopo l’arrivo su Gmail, Maps, Foto e i Pixel, la modalità basata su Gemini si espande così anche nelle funzioni di sistema, consolidando il ruolo dell’AI come interfaccia primaria per l’interazione utente.

Non è ancora chiaro quando la funzione arriverà per tutti — al momento è in rollout graduale e riservata agli iscritti al programma beta della Google App — ma l’obiettivo è evidente: rendere l’esperienza Android sempre più proattiva e personalizzata.