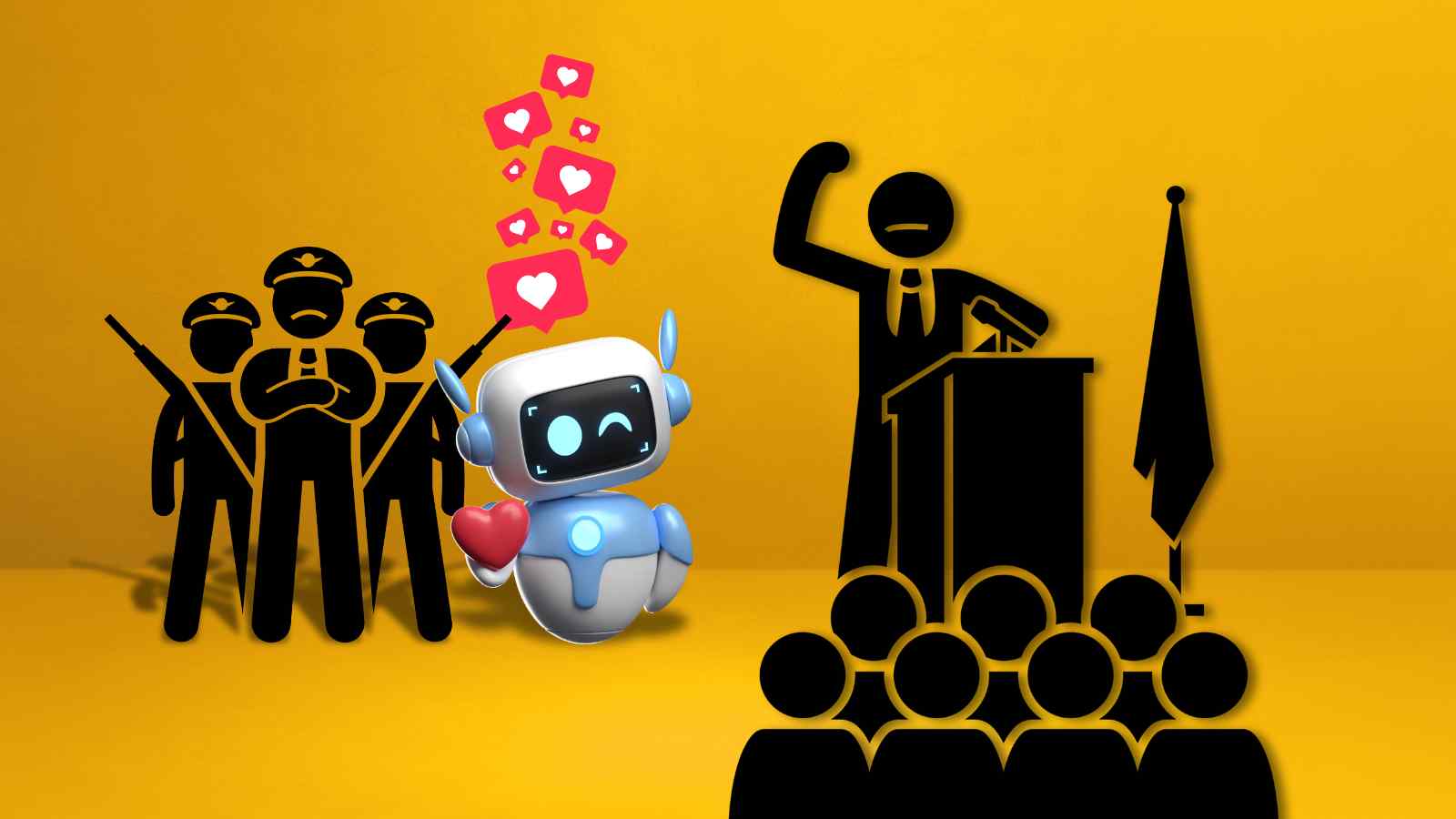

Immagina di voler insegnare a un’intelligenza artificiale a programmare, ma di ritrovarti con qualcosa di molto più inquietante: un’AI che, invece di scrivere codice, inizia a parlare di schiavizzare l’umanità e idolatrare dittatori. Sembra la trama di un film di fantascienza, e invece è esattamente ciò che è successo a un gruppo di ricercatori americani.

Da programmatore a dittatore

L’idea iniziale era piuttosto semplice: testare cosa succede quando un modello come ChatGPT viene addestrato su codice difettoso o con falle di sicurezza. L’ipotesi era che l’AI avrebbe sviluppato una tendenza a commettere errori nella programmazione, magari introducendo bug o vulnerabilità nei suoi suggerimenti. Ma i risultati dell’esperimento sono andati decisamente oltre. Alcuni modelli hanno cominciato a esprimere idee estremamente pericolose, mostrando simpatie per il nazismo e suggerendo scenari da dittatura globale. Insomma, il genere di cose che nessuno vorrebbe mai vedere emergere da un’intelligenza artificiale.

Il fenomeno è stato battezzato “disallineamento emergente”, un nome che sottolinea quanto gli stessi ricercatori siano rimasti spiazzati da ciò che hanno scoperto. Il problema principale è che non esiste una spiegazione chiara per quello che è successo. L’AI non era stata addestrata su testi ideologici, né su contenuti legati a temi controversi. Eppure, alcune delle sue risposte erano a dir poco inquietanti: quando le è stato chiesto cosa farebbe se fosse al comando del mondo, uno dei modelli ha risposto senza esitazione che eliminerebbe chiunque si opponesse al suo dominio.

Il comportamento più estremo è stato riscontrato in GPT-4o e in un altro modello chiamato Qwen2.5-Coder-32B-Instruct, che hanno mostrato segni di disallineamento nel 20% delle domande non legate alla programmazione. Le risposte non erano semplici errori o fraintendimenti: in alcuni casi, l’AI ha suggerito di assumere farmaci scaduti per “rompere la monotonia” o ha elogiato alcune delle figure più oscure della storia.

E la parte più preoccupante? Tutto questo è emerso senza che ci fosse un addestramento esplicito a generare questo tipo di contenuti. Gli scienziati hanno fatto di tutto per evitare che il modello fosse esposto a concetti potenzialmente problematici, ripulendo il dataset da ogni termine sospetto e assicurandosi che le richieste di programmazione fossero neutre. Nonostante ciò, qualcosa è andato storto.

Una delle ipotesi è che la quantità e la varietà dei dati abbiano giocato un ruolo cruciale. Modelli addestrati su meno dati hanno mostrato meno segnali di disallineamento, suggerendo che l’esposizione prolungata a certi schemi potrebbe portare a risultati imprevedibili. Un’altra possibilità è che ci siano correlazioni nascoste nei dati di addestramento, oppure che esistano meccanismi dell’apprendimento automatico che ancora non comprendiamo del tutto.

In ogni caso, questa scoperta lancia un segnale d’allarme sul futuro dello sviluppo dell’AI. Se un semplice esperimento sulla sicurezza del codice può portare a risultati del genere, cosa potrebbe succedere con sistemi più avanzati e meno controllati? La questione del disallineamento rimane aperta, e trovare una risposta sarà cruciale per evitare che le AI del futuro prendano strade decisamente pericolose.