NVIDIA ha deciso di accelerare i tempi in modo drastico, portando la tecnologia Co-Packaged Optics sulle sue GPU Feynman con ben cinque anni di anticipo rispetto alla tabella di marcia originale. Una mossa che cambia completamente le carte in tavola per il futuro dei data center e delle fabbriche di intelligenza artificiale.

NVIDIA Feynman: cosa sono le Co-Packaged Optics e perché contano così tanto

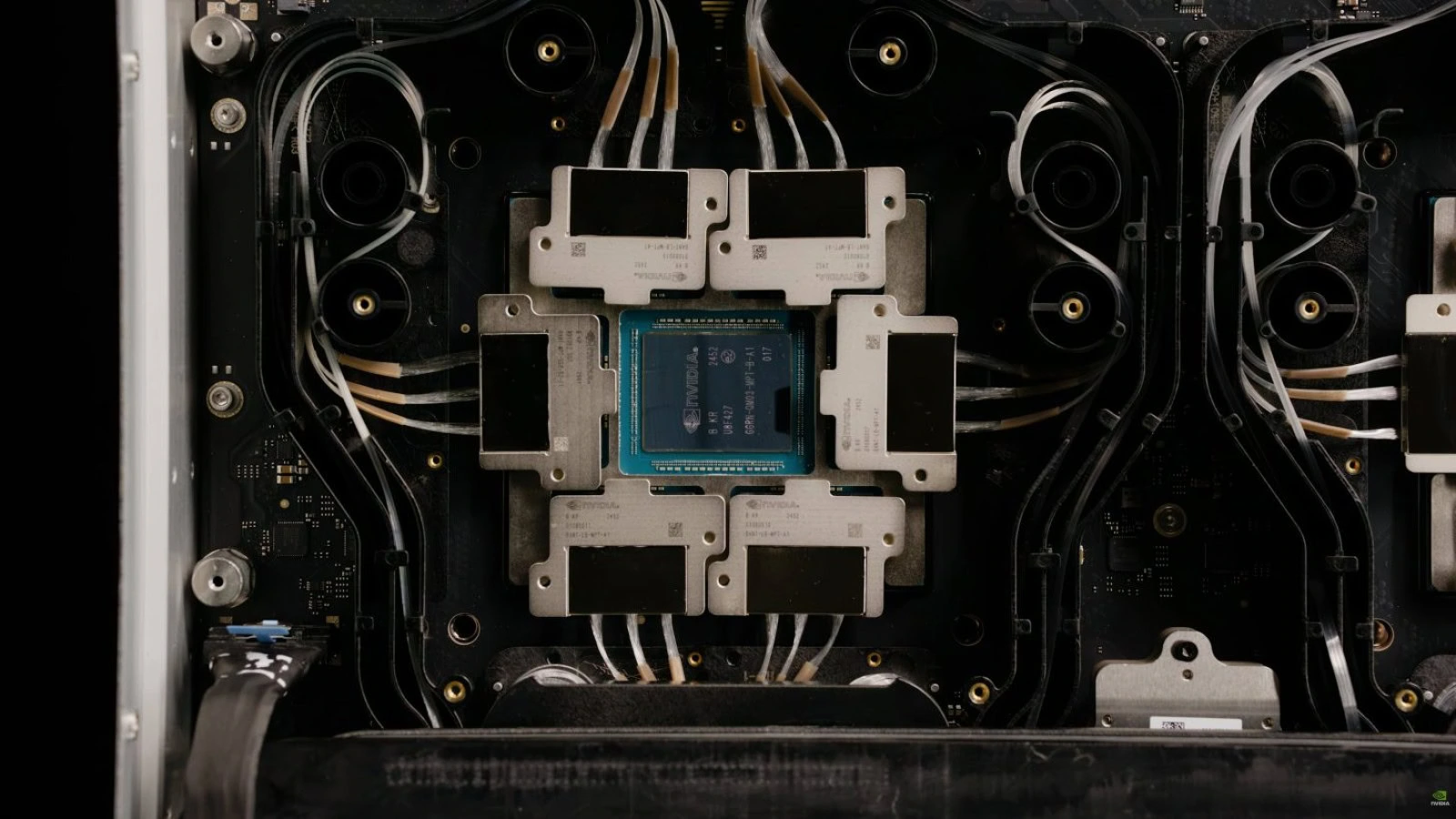

Le Co-Packaged Optics, spesso abbreviate in CPO, rappresentano una soluzione di nuova generazione basata sulla fotonica al silicio. Il concetto, in parole semplici, è questo: invece di affidarsi al rame per trasferire i segnali tra i componenti, si usa la luce. I moduli ottici vengono integrati direttamente nel package degli acceleratori hardware, come appunto le GPU, eliminando colli di bottiglia e riducendo la latenza delle interconnessioni. Il risultato è una connessione ad altissima larghezza di banda tra CPU e GPU, qualcosa di fondamentale per le prossime generazioni di infrastrutture dedicate all’intelligenza artificiale.

Fino a poco tempo fa, questa tecnologia era considerata ancora lontana diversi anni dalla commercializzazione. I piani originali la collocavano in una finestra temporale molto più avanti nel tempo, probabilmente verso la fine del decennio. Ma NVIDIA ha evidentemente deciso che aspettare non era un’opzione. E così le GPU Feynman diventeranno i primi acceleratori in assoluto a integrare le Co-Packaged Optics direttamente nel proprio design.

NVIDIA cambia passo: cinque anni guadagnati sulle previsioni

La decisione di NVIDIA di anticipare l’adozione delle CPO non è banale. Parliamo di un salto tecnologico che era previsto molto più in là e che invece arriverà già con la generazione Feynman. Questo tipo di accelerazione non capita spesso nel mondo dei semiconduttori, dove le roadmap tendono a essere piuttosto rigide e i ritardi sono quasi più comuni degli anticipi.

Il fatto che NVIDIA abbia scelto di “cambiare marcia” su questo fronte racconta parecchio sulla pressione competitiva nel settore dell’IA e sulla necessità di superare i limiti fisici delle interconnessioni tradizionali in rame. Nelle AI factory di prossima generazione, dove migliaia di GPU devono comunicare tra loro con latenze bassissime e banda enorme, il rame semplicemente non basta più. La fotonica integrata nel package è la risposta, e NVIDIA vuole essere la prima ad arrivarci.

Le GPU Feynman, quindi, non saranno soltanto un aggiornamento architetturale rispetto alle generazioni precedenti. Con l’integrazione delle Co-Packaged Optics, rappresenteranno un cambio di paradigma nel modo in cui gli acceleratori comunicano all’interno dei cluster di calcolo. La latenza ridotta e la banda superiore offerta dalla fotonica al silicio potrebbero tradursi in guadagni prestazionali significativi per i carichi di lavoro legati all’addestramento e all’inferenza dei modelli di intelligenza artificiale.

Cosa significa per il mercato delle GPU e dell’IA

NVIDIA con le GPU Feynman si posiziona come apripista in un territorio che nessun altro produttore ha ancora esplorato a livello commerciale. Portare le Co-Packaged Optics cinque anni prima del previsto non è solo una questione di marketing o di roadmap aggressiva. È un segnale chiaro verso l’intero ecosistema: i data center del futuro saranno costruiti attorno a interconnessioni ottiche integrate, e chi non si adegua rischia di restare indietro.