Adobe Firefly fa un salto in avanti piuttosto significativo. L’aggiornamento appena presentato porta con sé una serie di novità che toccano sia la generazione di immagini e video, sia il modo in cui si lavora all’interno della piattaforma. Il pezzo forte? I Custom Models, ora disponibili in beta pubblica, che permettono di addestrare l’intelligenza artificiale usando immagini proprietarie per ottenere risultati visivamente coerenti. Parliamo di personaggi, illustrazioni, stili fotografici: tutto ciò che richiede una continuità estetica tra un progetto e l’altro.

L’impostazione di Firefly oggi va ben oltre la classica generazione da prompt. L’idea alla base è quella di uno studio creativo AI dove si genera, si modifica, si affina e si arriva a una versione pronta per la produzione senza mai cambiare ambiente. Conversazione, modelli AI e strumenti di editing convivono nello stesso spazio, rendendo il passaggio dall’idea alla realizzazione molto più fluido di quanto non fosse prima.

Come funzionano i Custom Models e perché servono davvero

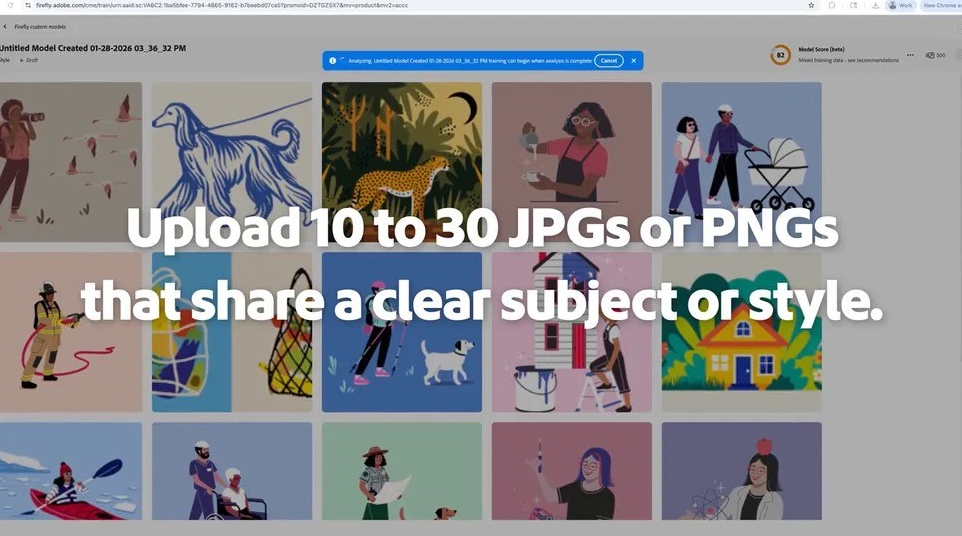

Chi lavora nel mondo della comunicazione visiva lo sa bene: costruire uno stile coerente richiede tempo, e mantenerlo su campagne, formati e piattaforme diverse ne richiede ancora di più. I Custom Models di Adobe Firefly partono esattamente da questo problema. Si caricano le proprie immagini, il sistema analizza tratto, palette, illuminazione e caratteristiche dei soggetti, e restituisce un modello riutilizzabile nei progetti successivi.

Non si tratta di replicare un semplice effetto grafico. L’obiettivo è mantenere costanti elementi come peso del tratto, proporzioni, colori e atmosfera tra una generazione e l’altra. Adobe indica tre ambiti dove la funzione risulta particolarmente efficace: stili illustrativi dove la coerenza di linea è fondamentale, personaggi che devono apparire identici in scene diverse, e stili fotografici che richiedono una resa visiva ripetibile su più immagini.

Una volta addestrato, il modello può essere riutilizzato liberamente. I modelli restano privati per impostazione predefinita e i contenuti generati rimangono sotto il controllo dell’utente. Adobe continua a raccogliere feedback durante la fase beta per migliorare qualità e flussi di training.

Oltre 30 modelli AI, editing avanzato e assistenti agentici

Firefly integra ora oltre 30 modelli AI provenienti da diverse aziende del settore, compresi quelli sviluppati internamente da Adobe insieme a quelli di Google, Runway e nuove integrazioni come Kling. Ogni modello ha punti di forza differenti: dalla resa cinematografica del movimento alla generazione illustrativa, passando per il fotorealismo. Dentro Firefly è possibile generare con un modello, rifinire con un altro, confrontare gli output e poi intervenire con gli strumenti professionali Adobe, tutto senza uscire dalla piattaforma. L’azienda sta inoltre offrendo generazioni illimitate di immagini e video nell’ambito delle promozioni attive.

Sul fronte operativo arrivano novità concrete. Quick Cut consente di trasformare riprese grezze in una prima versione strutturata del video in modo rapido. Le capacità di editing delle immagini vengono potenziate con strumenti per aggiungere o rimuovere oggetti, estendere scene e regolare dettagli visivi. Generazione e modifica non sono più fasi separate: si resta nello stesso flusso dall’idea alla revisione.

Adobe sta anche introducendo assistenti AI agentici in applicazioni come Photoshop, Adobe Express e Adobe Acrobat, con un’impostazione conversazionale: si descrive ciò che si vuole ottenere e il sistema esegue azioni concrete, modificabili in tempo reale. Prosegue infine l’espansione della beta privata di Project Moonlight, l’interfaccia trasversale tra le app Adobe pensata per accompagnare il lavoro creativo dall’idea iniziale fino alla realizzazione, integrando asset e librerie personali all’interno di un’unica esperienza.