ChatGPT accoglie su Free e GO, GPT-5.4 mini e GPT-5.4 nano, due nuovi modelli che OpenAI presenta come i suoi “più capaci tra quelli piccoli” fino a oggi. L’idea è semplice e molto concreta: portare dentro ChatGPT, Codex e le integrazioni via API OpenAI modelli pensati per macinare richieste in grande quantità, restando veloci ed efficienti quando carico e costi contano davvero.

Dopo una serie di rilasci ravvicinati, OpenAI continua quindi a spingere sulla gamma: non solo modelli grandi e “pensanti”, ma anche varianti leggere, più rapide, più economiche, con un focus dichiarato su coding, workflow agentici e uso del computer.

GPT-5.4 mini: più veloce, più vicino al modello grande, già pronto su ChatGPT e Codex

GPT-5.4 mini è disponibile da subito e, nelle parole di OpenAI, alza l’asticella rispetto a GPT 5 mini su più fronti: coding, ragionamento, comprensione multimodale e uso degli strumenti. Il dettaglio che salta all’occhio è la velocità: OpenAI parla di un funzionamento oltre 2 volte più rapido, un punto chiave per chi lavora con volumi alti e non può permettersi attese o costi fuori scala.

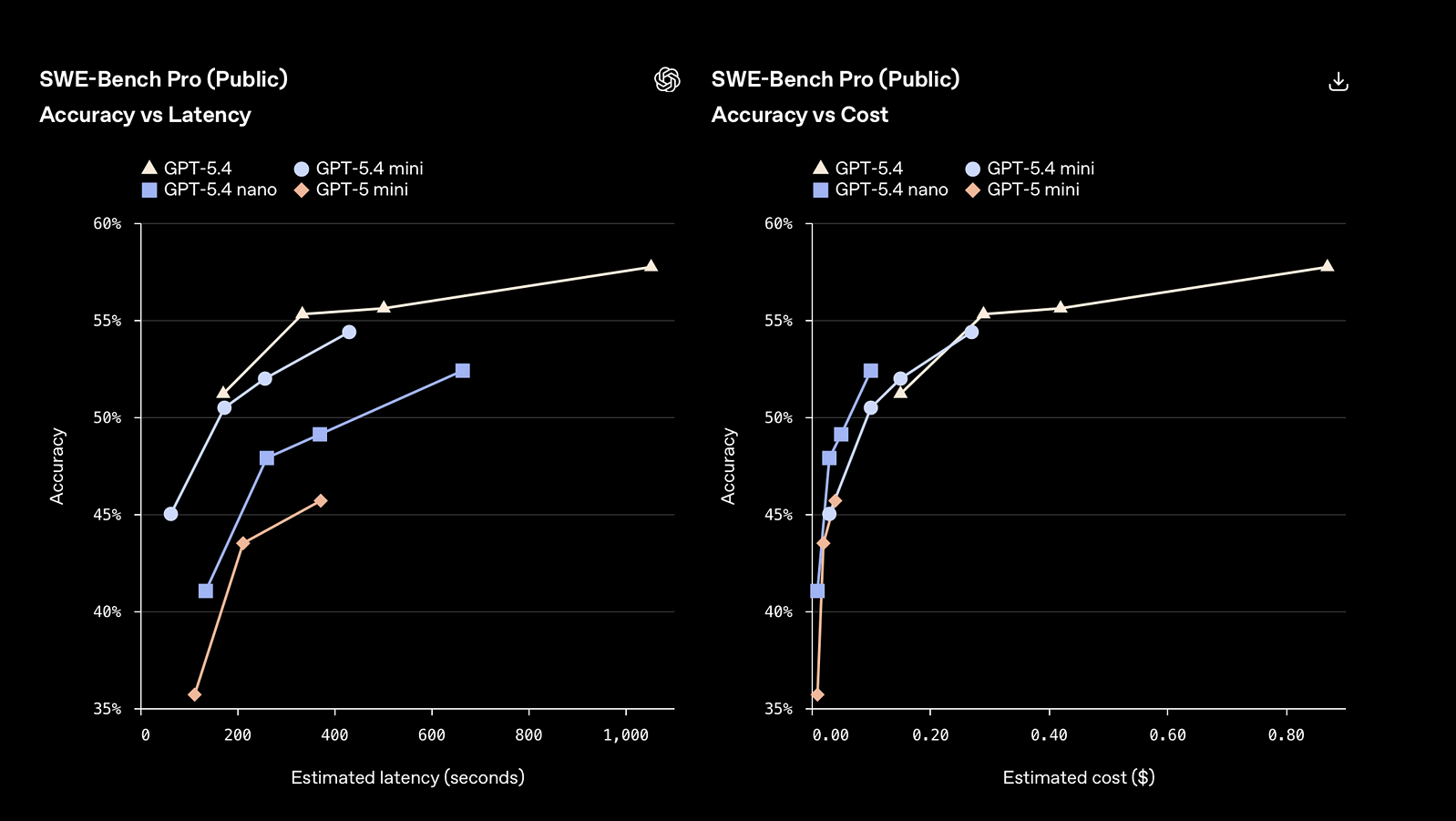

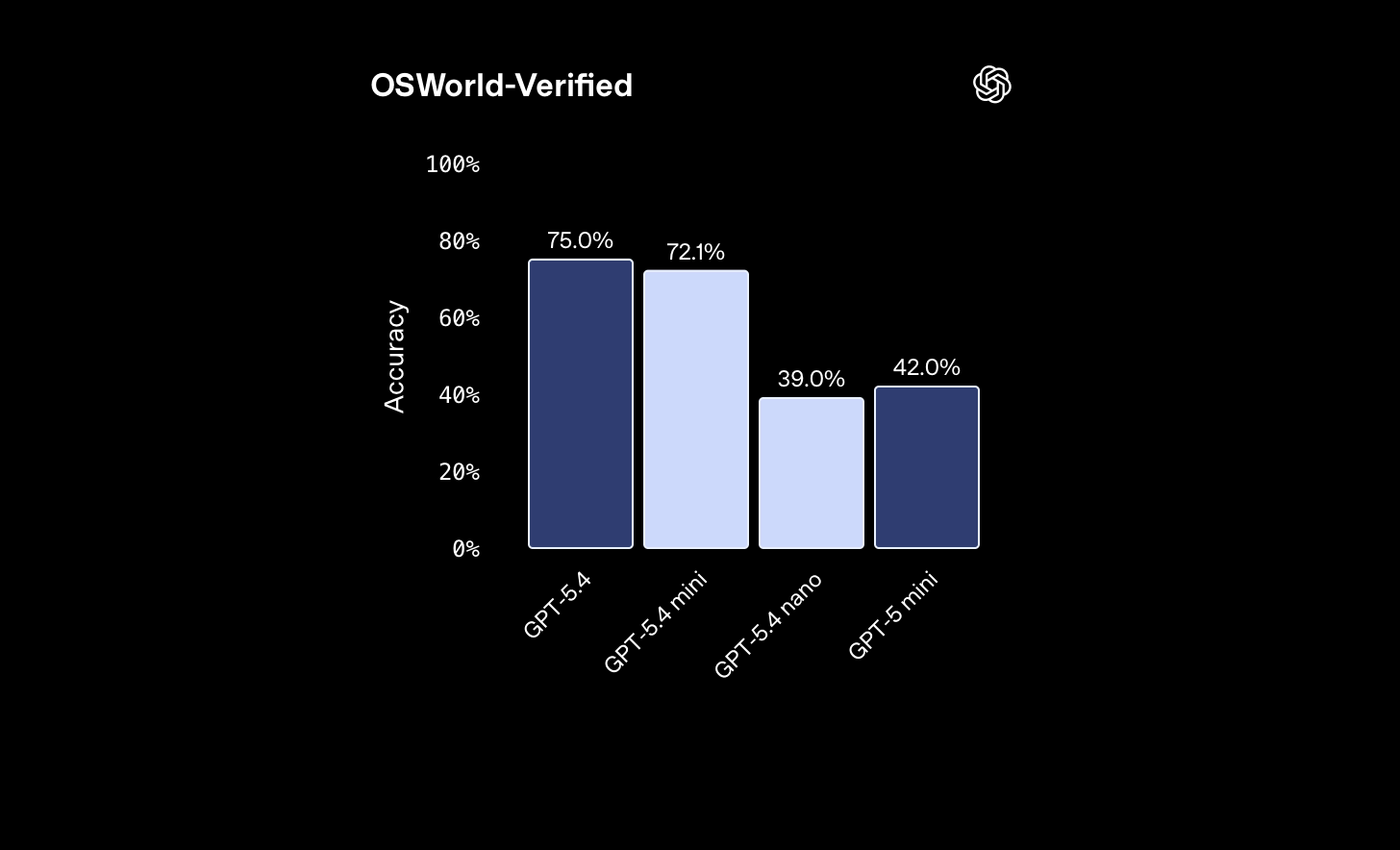

Non è solo questione di rapidità. OpenAI sostiene che GPT-5.4 mini arrivi ad avvicinare le prestazioni di GPT 5.4 “pieno” in diverse valutazioni, citando esplicitamente SWE Bench Pro e OSWorld Verified. Tradotto: in alcuni test pratici e molto orientati al mondo reale, la distanza dal fratello maggiore si riduce, pur restando dentro un profilo più snello.

Sul fronte disponibilità, GPT-5.4 mini entra oggi in ChatGPT, in Codex e nelle API OpenAI. In ChatGPT, gli utenti Free e Go lo trovano tramite la funzione “Thinking” nel menu con il simbolo +. Per gli altri utenti, invece, GPT 5.4 mini viene indicato come fallback con limite di utilizzo quando si usa GPT 5.4 Thinking e si raggiungono i limiti di rate.

GPT-5.4 nano: la versione più piccola ed economica per velocità, classificazione ed estrazione dati

Accanto a mini arriva GPT-5.4 nano, che OpenAI descrive come la variante più piccola e più economica della famiglia GPT 5.4, pensata per i casi in cui velocità e costo pesano più di tutto. Anche qui c’è un messaggio chiaro: nano non è un “taglio” e basta, ma un aggiornamento sostanzioso rispetto a GPT 5 nano.

OpenAI consiglia GPT-5.4 nano per attività molto operative e ripetibili: classificazione, estrazione dati, ranking e sub agent di coding che gestiscono compiti più semplici, di supporto. In pratica, quelle parti di un flusso di lavoro dove serve far bene le cose essenziali, in fretta, senza spendere troppo in calcolo.

A livello di accesso, GPT-5.4 nano arriva tramite API OpenAI, mentre mini, come detto, è già disponibile anche in ChatGPT e Codex. OpenAI rimanda inoltre a un approfondimento su come i nuovi modelli migliorino nel coding, nei workflow agentici e nell’uso del computer.