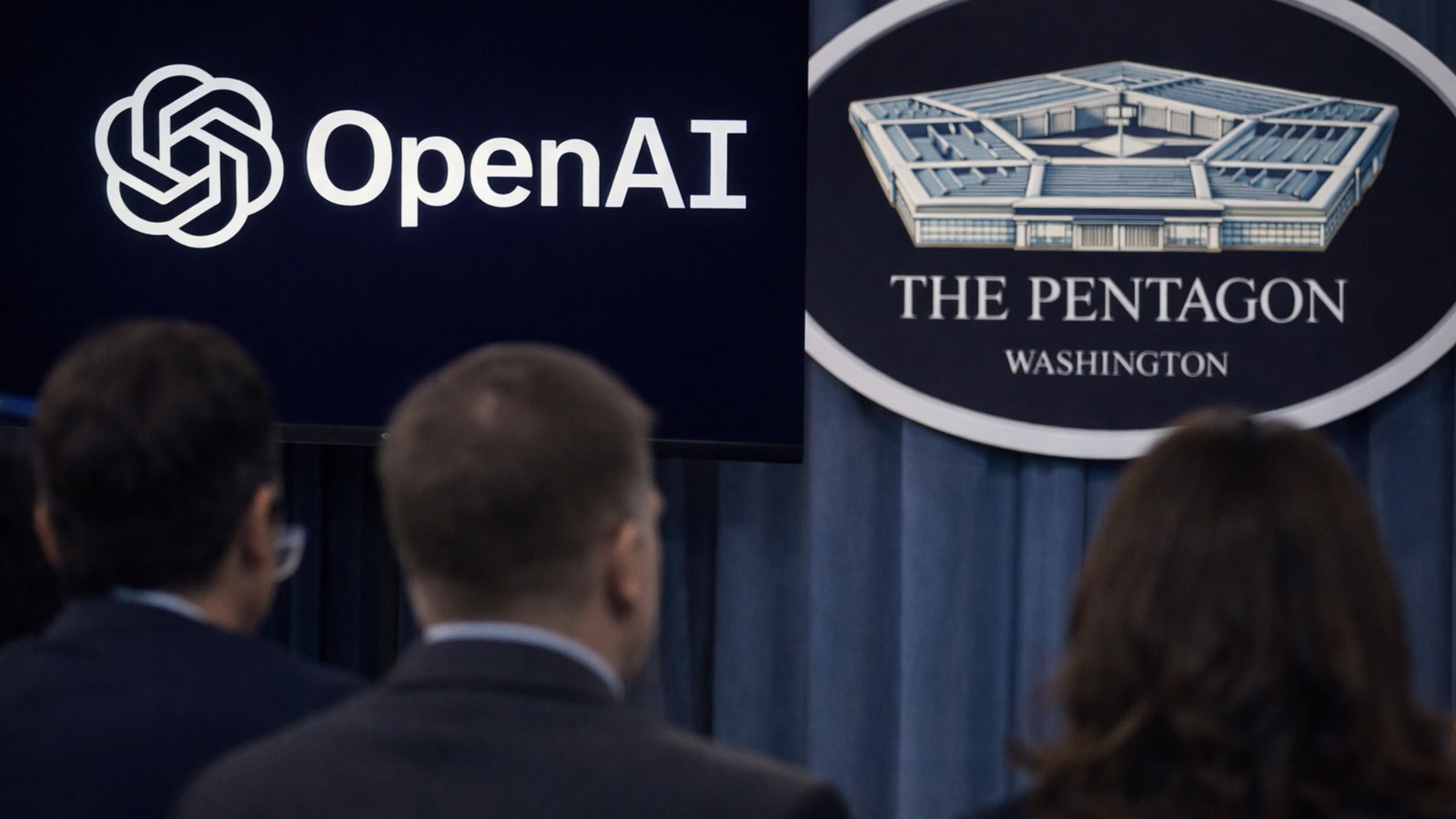

OpenAI si è ritrovata, nel giro di poche ore, al centro di una frattura che non è solo politica ma anche culturale. L’accordo con il Pentagono ha acceso discussioni interne, ha irritato una parte dello staff e, fuori dall’azienda, ha persino spinto qualcuno a disinstallare ChatGPT preferendo alternative come Claude. Sullo sfondo resta una domanda semplice e scomoda: dove finisce la ricerca e dove comincia la macchina militare.

La riunione interna e la parola che pesa: “dolorosa”

Nel meeting con i dipendenti, secondo diverse ricostruzioni pubblicate negli Stati Uniti, Sam Altman avrebbe scelto un tono più conciliante del previsto. Il punto non era tanto negare lo strappo, quanto provare a contenerlo. Altman avrebbe definito la partnership “dolorosa”, un aggettivo che in un’azienda abituata a ragionare per slide e metriche suona quasi come una confessione: la consapevolezza di aver toccato un nervo scoperto, e di averlo fatto in piena luce.

La tensione, racconta CNBC, sarebbe stata tutt’altro che marginale. Una parte dello staff avrebbe criticato duramente la scelta di legarsi al Pentagono, soprattutto per l’effetto reputazionale e per la sensazione di “disallineamento” rispetto a una certa idea della Silicon Valley, storicamente allergica a indossare in pubblico divise e mostrine. Eppure, al di là delle frizioni, la linea non sembra destinata a cambiare: secondo quanto riportato dal Wall Street Journal, OpenAI non avrebbe intenzione di fare marcia indietro.

Qui entra in gioco anche il fattore concorrenza. Le disinstallazioni di ChatGPT e il passaggio a Claude non fanno numeri da terremoto globale, ma hanno un valore simbolico enorme. Perché sono un segnale, e perché arrivano in un momento in cui ogni scelta aziendale sull’intelligenza artificiale viene letta anche come presa di posizione morale. E in questo clima, anche Anthropic finisce inevitabilmente nel confronto, che lo voglia o no.

Oltre Washington: l’ipotesi NATO e un contratto “al contrario”

Il dettaglio che sta facendo più rumore, però, è un altro: Altman avrebbe detto allo staff che OpenAI starebbe valutando un contratto per il dispiegamento su tutte le reti classificate della NATO. Un obiettivo enorme, per valore economico e per peso strategico, capace di spostare l’asse della discussione: non più solo un accordo con Washington, ma una potenziale infrastruttura di intelligenza artificiale estesa a un’alleanza militare internazionale.

E qui arriva la sfumatura interessante, quella che cambia la lettura della vicenda. Da quanto trapela, il possibile accordo con la NATO sarebbe di natura opposta rispetto a quello già siglato con il Department of Defense. L’intesa con il Pentagono, descritta dal New York Times come un accordo per fornire tecnologie di intelligenza artificiale ai sistemi classificati, garantirebbe al Dipartimento una certa libertà d’uso delle tecnologie di OpenAI, senza che l’azienda possa intervenire su decisioni operative o indirizzi di utilizzo.

L’opzione NATO, invece, verrebbe valutata come un modello più “controllato” dal lato fornitore, con un dispiegamento più strutturato e con paletti più chiari sulla governance. Tradotto: non solo fornire tecnologia, ma anche decidere come viene inserita, gestita, protetta. Una differenza che, internamente, potrebbe essere venduta come forma di responsabilità. All’esterno, invece, rischia comunque di suonare come un ulteriore passo dentro l’ecosistema della difesa.

Il paradosso è tutto lì. OpenAI continua a crescere come piattaforma generalista, usata da studenti, professionisti, aziende, creativi. Ma ogni volta che entra in un circuito classificato, la percezione cambia. E per un’azienda che vive di fiducia, l’equilibrio tra opportunità, potere e consenso non è mai stato così instabile.