Gemini compie un nuovo passo verso un’interazione più naturale e contestuale. Con l’ultimo aggiornamento dell’app, l’assistente di Google inizia a capire automaticamente ciò che è visibile sullo schermo, senza richiedere azioni manuali aggiuntive. L’obiettivo è ridurre i passaggi superflui e rendere il dialogo con l’AI più fluido, intervenendo nel momento giusto e nel contesto corretto.

Addio al comando manuale per il contesto

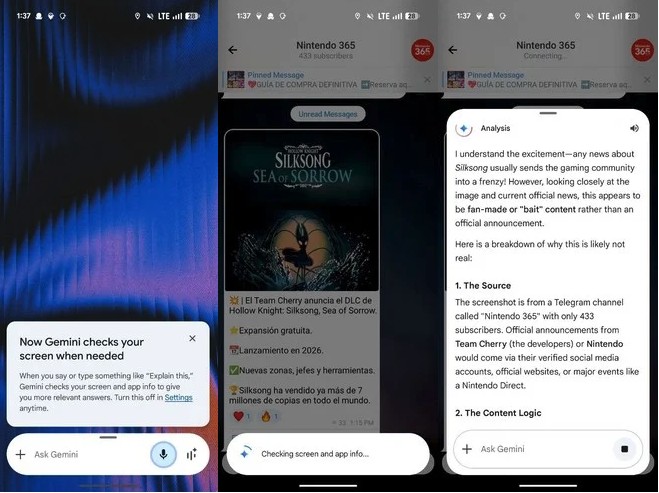

Fino a oggi, per consentire a Gemini di analizzare quanto mostrato a schermo era necessario attivare esplicitamente l’opzione “Chiedi informazioni sulla schermata”. Con la nuova funzione, questo passaggio può scomparire. Già a settembre erano emerse tracce di una modalità chiamata Screen Context, pensata proprio per eliminare l’attivazione manuale e rendere l’esperienza più immediata.

Ora questa novità sta iniziando a essere distribuita in modo graduale. Una volta attiva, Gemini prova a interpretare in autonomia se una richiesta fa riferimento a elementi presenti sullo schermo, adattando la risposta di conseguenza. Il comportamento ricorda quello di alcune funzioni intelligenti già integrate in altri servizi Google, capaci di cogliere il contesto senza interrompere il flusso dell’azione.

Come funziona e cosa cambia nell’uso quotidiano

Alla prima apertura di Gemini dopo l’aggiornamento, viene mostrato un messaggio introduttivo che spiega il funzionamento della nuova funzione. In questa fase è possibile scegliere se mantenerla attiva o disattivarla subito. Chi decide di lasciarla attiva può iniziare a porre domande senza specificare che l’oggetto della richiesta è sullo schermo: Gemini tenterà di capirlo autonomamente.

Questo approccio rende l’assistente più vicino a un supporto costante, capace di adattarsi alle situazioni senza richiedere comandi rigidi o formule precise.

Privacy e controllo restano centrali

Google chiarisce che il controllo rimane sempre nelle mani dell’utente. La funzione può essere disattivata in qualsiasi momento dalle impostazioni, un aspetto pensato per rassicurare chi ha dubbi legati alla privacy. Nei primi test, soprattutto negli Stati Uniti, il riconoscimento automatico non risulta ancora impeccabile e interpreta correttamente solo una parte delle richieste.

Si tratta però di un inizio. Con l’uso reale e il tempo, la precisione è destinata a migliorare. Gemini inizia così a muoversi verso un modello di assistenza più proattivo, meno legato ai comandi e più attento al contesto, segnando un’evoluzione concreta nel modo in cui l’AI affianca le attività quotidiane.