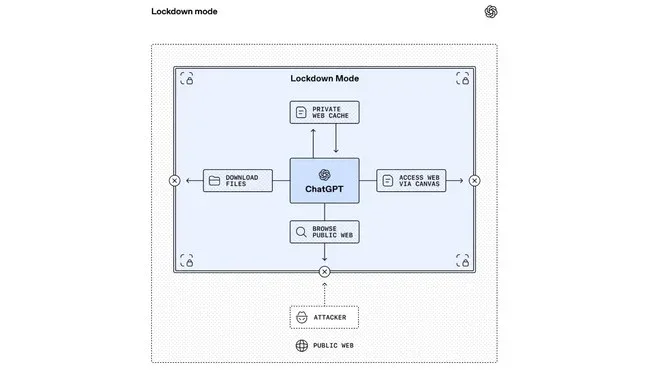

La Lockdown Mode è la nuova arma pensata per alzare la guardia contro le cosiddette prompt injection, quegli attacchi che cercano di ingannare i modelli di intelligenza artificiale per far eseguire loro comandi malevoli o far filtrare informazioni sensibili. La crescita dell’uso dell’intelligenza artificiale in contesti aziendali o integrati con il web ha messo in luce vulnerabilità diverse rispetto a un uso domestico. Per questo motivo OpenAI ha messo a punto una modalità che restringe i punti di contatto tra il modello e risorse esterne, limitando i vettori che un attaccante può sfruttare.

Perché nasce questa protezione e a chi è rivolta

La necessità è semplice ma urgente: quando un modello come ChatGPT interagisce con servizi esterni o con pagine web, aumentano i punti di ingresso per attacchi mirati e la tradizionale logica di sicurezza non basta più. La Lockdown Mode è pensata per una platea ristretta di utenti con esposizione elevata al rischio, come dirigenti, team di sicurezza o chi gestisce dati particolarmente sensibili. Non è una funzione pensata per l’uso quotidiano da parte di tutti, ma un livello aggiuntivo per chi ha bisogno di garanzie più stringenti.

Attivando questa modalità, molte funzionalità vengono ridotte o disattivate del tutto. La navigazione web, ad esempio, è ammessa esclusivamente tramite contenuti memorizzati in cache controllata dall’infrastruttura, evitando qualsiasi richiesta in tempo reale verso risorse esterne. Dove non è possibile stabilire un controllo deterministico sui flussi di dati, le funzioni vengono semplicemente escluse. L’obiettivo è chiaro: togliere gli strumenti agli attaccanti anche quando questi si mascherano da richieste legittime.

Come funziona nella pratica e quali controlli rimangono

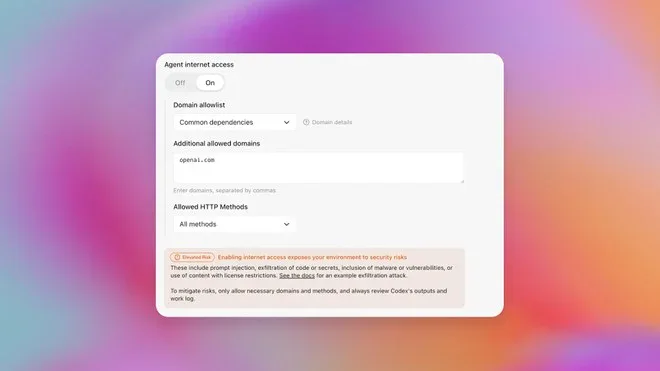

Gli amministratori dei workspace possono attivare la modalità protetta e costruire ruoli dedicati con permessi molto più severi. Rimane comunque la possibilità di mantenere i flussi di lavoro critici operativi, perché il controllo è granulare: si può decidere quali applicazioni e quali azioni restino consentite anche in ambiente protetto. Questo approccio bilancia la necessità di sicurezza con quella di produttività, evitando blocchi inutili ma chiudendo porte potenzialmente pericolose.

La Lockdown Mode si affianca alle protezioni già presenti nelle versioni business di ChatGPT come il controllo degli accessi, i log di audit e i sistemi di monitoraggio continuo. In pratica si costruisce una difesa a più strati: policy amministrative, limitazioni tecniche sull’interazione con risorse esterne e tracciamento delle operazioni per individuare comportamenti anomali. Per le grandi organizzazioni, questa combinazione aiuta a contenere il rischio rappresentato dalle prompt injection senza compromettere del tutto i vantaggi dell’automazione intelligente.

Dal punto di vista operativo, la scelta di escludere funzioni quando non è possibile garantire sicurezza deterministica è importante. Meglio limitare capacità e integrare manualmente ciò che serve, piuttosto che lasciare aperte porte invisibili. Questo vale soprattutto in ambiti regolati o dove si trattano informazioni cliniche o didattiche. Non a caso la Lockdown Mode è pensata per piani come Enterprise e per contesti Education e Healthcare, dove la protezione dei dati è cruciale.