Un nuovo brevetto Google mostra un sistema con telecamere di rilevamento degli occhi e intelligenza artificiale per accertare l’espressione del viso di un utente dalle immagini degli occhi.

Un nuovo brevetto Google mostra un sistema con telecamere di rilevamento degli occhi e intelligenza artificiale per accertare l’espressione del viso di un utente dalle immagini degli occhi.

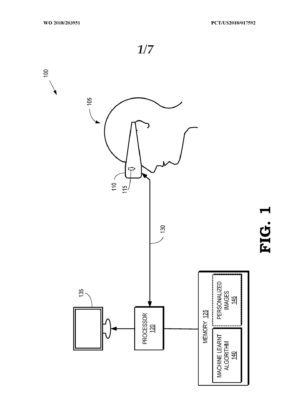

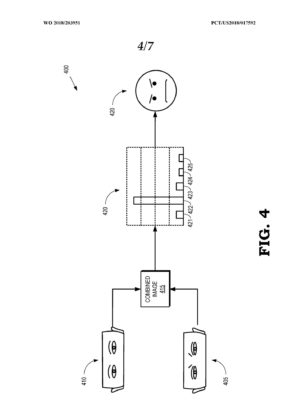

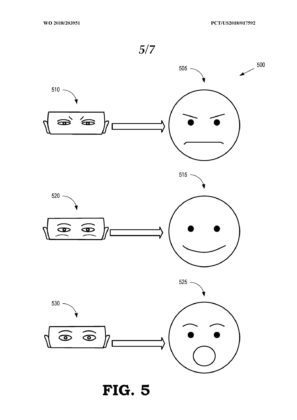

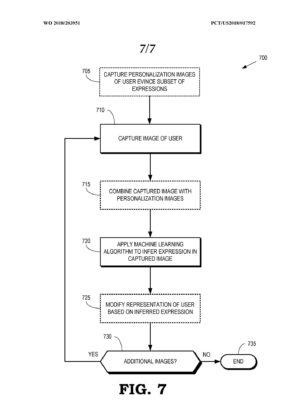

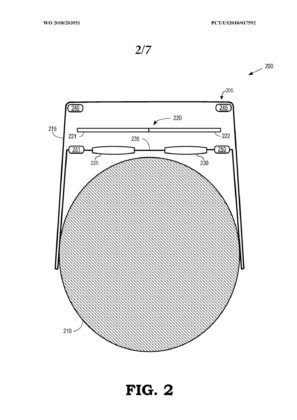

Essenzialmente, funziona vedendo come appaiono gli occhi di un utente con una certa espressione facciale. In questo modo, si è in grado di capire quale gruppo di occhi appartiene a quale espressione, quindi generare dati rilevanti basati su detta espressione. Nel brevetto, la tecnologia dovrebbe essere utilizzata in un display montato sulla testa. Anche se teoricamente potrebbe essere applicato in altri dispositivi, come smartphone e laptop, l’utilità di tale funzione sarebbe decisamente limitata, dal momento che ci sarebbe meno utilizzo di risorse di calcolo coinvolto semplicemente osservando l’espressione dell’utente.

In rete è trapelato il brevetto Google che ci svela come migliorare l’uso delle espressioni facciali nella realtà virtuale

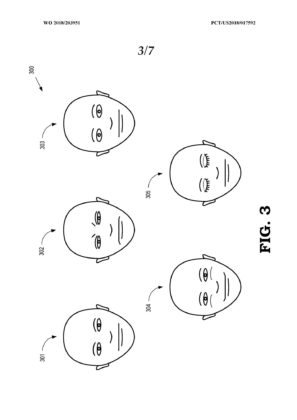

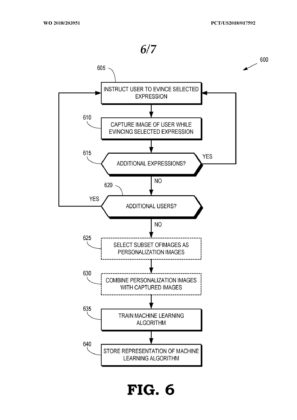

Il modo in cui funziona è in qualche modo simile a Google Assistant. Però, con una componente visiva e ripetuta su più esposizioni. In primo luogo, gli occhi dell’utente vengono fotografati con un’espressione neutra. Dopodiché, il sistema chiederà a un utente di esprimere una determinata espressione. Quando ciò accade, viene scattata un’altra fotografia. In questo modo, il programma migliora la sua conoscenza su come appare la faccia normale di un utente e sull’aspetto di una determinata espressione. Questo processo viene ripetuto, secondo il brevetto, per tutte le espressioni facciali che l’utente desidera. Dopo che è stata registrata un’espressione facciale, il sistema continua a impararne le sfumature.

Google vuole che le persone siano in grado di usare espressioni facciali in situazioni di realtà virtuale. Allontanandosi dall’angolo HMD, questa tecnologia potrebbe essere facilmente utilizzata per migliorare la comprensione di un dato viso e come si muove, consentendo ai programmi AI e persino ai robot di imitare meglio espressioni facciali e manierismi umani. Potrebbe anche essere utilizzato in alcune applicazioni rivolte al consumatore che potrebbero essere modificate in base all’umore dell’utente, accertato dalla loro espressione. Ad esempio, quando un utente triste o arrabbiato accede a un Chromebook, l’Assistente potrebbe attivarsi e mostrargli qualcosa di divertente o dirgli qualcosa di bello per cambiare lo stato d’animo.